Každý velký jazykový model od OpenAI, Anthropicu nebo Googlu platí stejnou daň. Čím delší vstup, tím víc práce. Ne dvakrát, ale čtyřikrát víc. Tohle platí od roku 2017, kdy transformátory ovládly obor. A právě sem míří startup Subquadratic se svým prvním modelem SubQ.

Firma vystoupila ze stínu s tvrzením, které část výzkumné komunity přivítala s upřímnou zvědavostí a část s otevřenou skepsí: jejich model SubQ 1M-Preview je prý první velký jazykový model postavený na plně subkvadratické architektuře, kde výpočetní náklady rostou lineárně s délkou kontextu. Při 12 milionech tokenů to podle firmy znamená skoro tisícinásobné snížení výpočtů pro pozornost oproti jiným modelům špičkové úrovně.

Co znamená kvadratické škálování?

Za normálního provozu se každý token v textu porovnává s každým jiným tokenem. Zdvojnásobíte délku vstupu? Cena se nezčtyřnásobí jen v metaforickém smyslu, ono se to opravdu čtyřnásobí. Tenhle mechanismus se jmenuje pozornost (anglicky attention) a tvoří základ všech transformátorových modelů.

Průmysl s tím bojuje léta. Vývojáři staví nad modely celé zásobníky náhradních řešení: systémy RAG tahají jen malou část relevantních dat, protože poslat celý datový korpus jednomu modelu prostě nejde. Vznikají strategie rozdělování textu na menší části, víceagentní řízení, promptovací techniky. „Dřív jsem ručně ladil prompty, systémy pro vyhledávání, podmíněnou logiku a propojoval jsem pracovní postupy. To je plýtvání lidskou inteligencí a zároveň to omezuje kvalitu výsledků." Řekl technický ředitel Subquadratic Alexander Whedon.

Standardní hranice pro dnes dostupné modely je 128 000 tokenů, špičkové cloudové modely jako Claude Sonnet 4.7 nebo Gemini 3.1 Pro dosahují až milionu. SubQ mluví o 12 milionech.

Technologie SSA vynechá výpočty, na kterých nezáleží

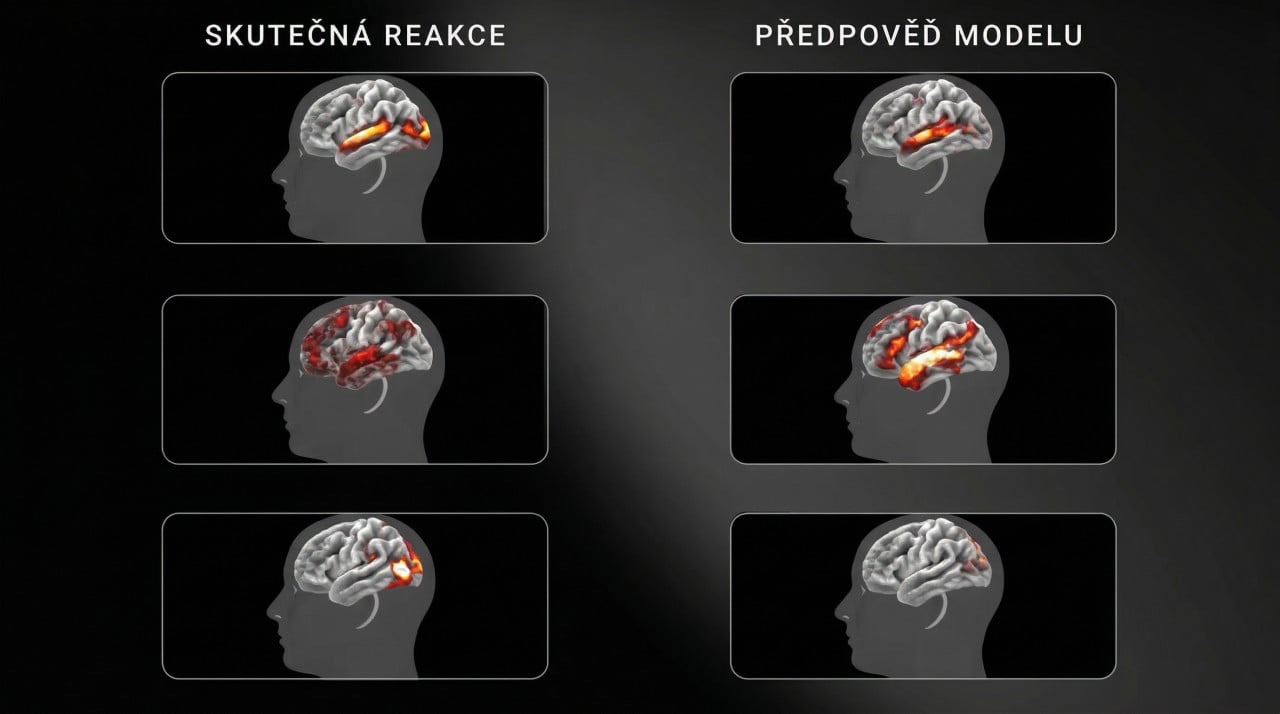

Technologie za SubQ nese název SSA, zkratka za Subquadratic Sparse Attention, volně přeloženo jako řídká pozornost se subkvadratickým škálováním. Princip je jednoduchý na popis, ale složitý na realizaci Místo porovnávání každého tokenu s každým jiným tokenem model sám rozhoduje, která porovnání stojí za to provést. A toto rozhodování závisí na obsahu, ne na pevně dané pozici v textu.

Výsledek? Podle vlastních čísel firmy SSA dosahuje na GPU B200 7,2násobné zrychlení prefill fáze oproti standardní pozornosti při 128 000 tokenech. Dále 13,2násobné zrychlení při 256 000 tokenech, 23násobné při 512 000 tokenech a 52,2násobné při 1 milionu tokenů. Čím delší kontext, tím větší výhoda. To je právě ten obrat, který Subquadratic prezentuje jako základ svého přístupu.

Firma trénovala model ve třech fázích: předtrénování, dohlížené doladění a fáze zpětného učení zaměřená speciálně na selhání při práci s dlouhým kontextem. Ta poslední část je důležitá. Jak popisuje technický blog firmy, modely mají tendenci odpovídat z blízkého kontextu, protože je snazší ho použít, i když klíčový důkaz leží daleko dřív v textu. SSA tuhle tendenci potlačuje.

Benchmarky vypadají skvěle, ale...

Na papíře SubQ konkuruje modelům organizací, které utrácejí miliardy. Na SWE-Bench Verified, testu skutečných softwarových úloh z GitHubu, SubQ dosáhl 81,8 % oproti 80,8 % u Opus 4.6 a 80,0 % u DeepSeek 4.0 Pro. Na RULER při 128 000 tokenech získal SubQ 95 %, Opus 4.6 měl 94,8 %. Na MRCR v2, náročném testu víceúrovňového vyhledávání napříč dlouhým kontextem, SubQ skóroval 65,9 % oproti Gemini 3.1 Pro s 26,3 % a Claude Opus 4.7 s 32,2 %.

Jenže výběr těchto tří testů není náhodný. Všechny zdůrazňují přesně to, na co je SubQ navržený: dlouhý kontext a programování. Širší hodnocení obecného uvažování, matematiky, vícejazyčného výkonu nebo bezpečnosti firma nezveřejnila. Kompletní přehled modelu je prý „zatím brzký". Navíc: mezi výzkumným výsledkem 83 bodů na MRCR v2 a ověřenou produkční verzí s 65,9 body zeje 17bodová mezera, která zůstává bez vysvětlení. Každý benchmark byl spuštěn jen jednou kvůli vysokým nákladům na inferenci, bez statistických intervalů spolehlivosti.

Firma také tvrdí, že na RULER 128K dosáhla přesnosti 95 % za 8 dolarů, zatímco Claude Opus za srovnatelný výkon zaplatil přibližně 2 600 dolarů. Bez zveřejněného ceníku API to zatím nelze ověřit.

Výzkumná komunita je v rozpacích

Pár hodin po oznámení explodovaly diskuse. Komentátor Dan McAteer to shrnul v jedné větě: „SubQ je buď největší průlom od transformátoru, nebo je to AI Theranos." Přirovnání ke slavnému podvodu Theranos možná přehání, ale vystihuje napětí ve vzduchu.

Zkušený inženýr Will Depue napsal, že SubQ je „skoro jistě řídká pozornost doladěná přes Kimi nebo DeepSeek", tedy že firma jen doladila existující open-source model. Whedon to potvrdil: firma skutečně vychází z vah open-source modelů jako výchozího bodu, a to z důvodu omezeného financování a fáze vývoje firmy. Depue pak zesílil kritiku a tvrdil, že tvrzení o O(n) škálování a uváděná čísla zrychlení si „prostě nesedí" a označil komunikaci za „extrémně špatně podanou, nebo prostě nepravdivou".

Jiní poukazují na strukturální otázku: pokud SubQ skutečně snižuje výpočty tisícinásobně a stojí méně než 5 % ceny Opusu, proč je přístup omezen brzký přístup? Vývojář Stepan Goncharov označil benchmarky za „velmi záměrně vybrané", jiný komentátor je popsal jako „podezřele dokonalé".

Na druhou stranu výzkumník John Rysana odmítl přirovnání Theranos jako přehnaný. Napsal, že jde o „subkvadratickou pozornost provedenou dobře, což je velmi smysluplné pro práci s dlouhým kontextem" a šance, že by šlo o podvod, jsou podle něj „extrémně nízké".

Magic.dev to slibovalo taky. A pak bylo ticho.

Asi nejpříznačnější kontext pro hodnocení SubQ nepřichází ze srovnávacích tabulek, ale z nedávné historie. Firma Magic.dev oznámila v srpnu 2024 model se 100milionovým kontextovým oknem a tvrzením o 1 000násobným zvýšením efektivity. Na základě toho získala přibližně 500 milionů dolarů. Začátkem roku 2026 neexistuje žádný veřejný důkaz o tom, že by LTM-2-mini někdo reálně používal.

Paralely jsou nápadné. Obě firmy tvrdily obrovské kontextové okno. Obě zmiňovaly přibližně tisícinásobné zvýšení efektivity. Obě cílily primárně na softwarové inženýrství. Obě spustily produkt s omezeným externím přístupem.

A to je jen jedna kapitola z delšího příběhu. Kimi Linear, DeepSeek Sparse Attention, Mamba i RWKV, všechny slibovaly subkvadratické škálování. Všechny narazily na stejný problém: architektury, které jsou teoreticky lineární, v praxi zaostávají za kvadratickou pozorností na reálných úlohách při velké škále. Nebo skončily jako hybridní modely, které kombinují subkvadratické vrstvy se standardní pozorností a tím pádem ztrácejí čisté výhody škálování.

Subquadratic si tohle dědictví neodpouští. Technický blog firmy jmenovitě rozebírá každý předchozí přístup a argumentuje, proč SSA jejich slabiny obchází. Jestli to tak skutečně je, může potvrdit jen nezávislé ověření.

Tým, peníze a otevřené otázky

Za firmou stojí CEO Justin Dangel, pětinásobný zakladatel s historií ve zdravotnických technologiích a spotřebním zboží, a CTO Alexander Whedon, dříve softwarový inženýr v Metě a vedoucí generativní AI v TribeAI. Tým zahrnuje 11 doktorů s kořeny z Mety, Googlu, Oxfordu, Cambridge, ByteDance a Adobe.

Subquadratic získala 29 milionů dolarů v investičním kole. Investoři zahrnují spoluzakladatele Tinderu Justina Mateena, bývalého partnera SoftBank Vision Fund Javiera Villamizara a rané investory z Anthropicu, OpenAI, Stripe a Brex. Ocenění firmy se podle The New Stack pohybuje kolem 500 milionů dolarů pro seed fázi bez zveřejněného výzkumu, bez recenzovaného vědeckého článku a bez přiznaných výnosů.

Firma neplánuje open-source release vah modelu, ale chce podnikům nabídnout nástroje pro vlastní dotrénování. Do konce roku 2026 cílí na kontextové okno o velikosti 50 milionů tokenů.

Whedon na technickou kritiku reagoval rychle a zveřejnil podrobný technický blog. To signalizuje tým, který chápe, že nestačí popsat výsledky, musí je doložit. Technická zpráva je ale stále označena jako „raná".