Tým Mety z oddělení FAIR (Fundamental AI Research) zveřejnil model s názvem TRIBE v2. Zkratka znamená TRImodal Brain Encoder, tedy trojmodální kodér mozku. Zní to odborně, ale princip je překvapivě srozumitelný: pustíte mu video, zvuk nebo text a on vám řekne, jak by na to reagoval lidský mozek.

Z experimentu se stal univerzální nástroj

Předchozí verze modelu, TRIBE v1, vznikla jako soutěžní projekt. Tým ji trénoval na mozkových skenech pouhých čtyř lidí a vyhrál s ní mezinárodní soutěž Algonauts 2025, kde se utkalo 263 týmů.

TRIBE v2 je úplně jiná liga. Meta shromáždila přes 1 000 hodin fMRI dat od 720 dobrovolníků. Ti lidé leželi ve skeneru a sledovali filmy, poslouchali podcasty, četli texty. Prostě normální lidské činnosti, ne umělé laboratorní podněty. Z toho všeho se model naučil rozpoznávat vzorce mozkové aktivity tak přesně, že dokáže předpovědět reakci mozku člověka, kterého nikdy neskenoval.

Ano, čtete správně. Funguje i na lidech, jejichž data nikdy neviděl. Tomu se říká predikce bez předchozího učení (anglicky zero-shot prediction) a je to asi ta nejpůsobivější vlastnost celého projektu.

Jak dokáže předvídat vaše myšlení?

TRIBE v2 pracuje ve třech krocích. Nejdřív zpracuje vstup: video analyzuje pomocí modelu V-JEPA 2, zvuk přes MERT a text skrze LLaMA 3.2. Tyhle tři „oči a uši" zachytí rysy obsahu tak, jak je vnímá umělá inteligence.

Pak vstoupí do hry transformátor, který všechny tři proudy informací propojí do jednoho společného vyjádření. A nakonec třetí vrstva přeloží toto vyjádření na mapu mozkové aktivity o zhruba 70 000 bodech (tzv. voxelech). Oproti původní verzi je to sedmdesátinásobné zvýšení rozlišení.

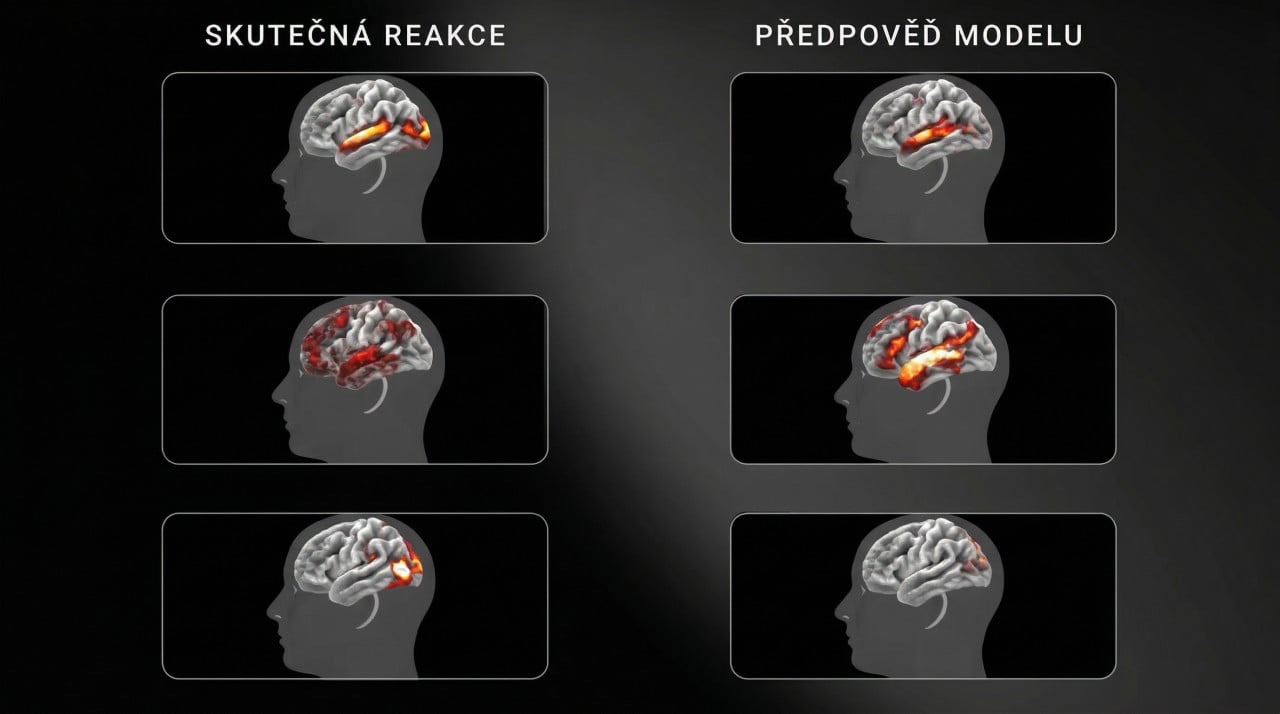

A výsledek? Když modelu ukážete filmový trailer, dostanete podrobnou mapu toho, které oblasti mozku by se rozsvítily, jak moc a v jakém pořadí. A co je až trochu znepokojivé: predikce modelu jsou v průměru přesnější než skutečný sken jednoho konkrétního člověka, protože reálné fMRI zachytí i šum, pohyby hlavy nebo tlukot srdce.

Jednodušší práce pro laboratoře

Jedno fMRI vyšetření stojí tisíce dolarů a trvá hodiny. Potřebujete drahou techniku, vyškolený personál a ochotného dobrovolníka, který vydrží nehybně ležet v hlučné trubici. TRIBE v2 tohle všechno obchází. Výzkumník si prostě pustí model na počítači, zadá podnět a během sekund má simulaci mozkové odezvy. Hypotézy, které by dřív vyžadovaly měsíce laboratorní práce, jde ověřit za odpoledne.

Pro lékaře a neurovědce to otevírá cestu k rychlejšímu testování teorií o neurologických poruchách. Místo toho, aby čekali na schválení studií a sháněli desítky pacientů, mohou nejdřív ověřit nápady „na počítači" a do laboratoře jít až s těmi nejslibnějšími.

Článek na Medium přirovnává TRIBE v2 k momentu, kdy Google v roce 2017 zveřejnil článek „Attention Is All You Need". Ten tehdy skoro nikoho nezaujal. Vypadal nudně a technicky. Jenže právě z něj vzešla architektura transformátorů, tedy základ dnešních jazykových modelů, ChatGPT a celé současné vlny umělé inteligence.

Může se stát, že TRIBE v2 je podobný tichý startovní výstřel. Tentokrát ne pro chatboty, ale pro porozumění lidskému vnímání. Pokud umíte předpovědět, jak mozek reaguje na obsah, máte v rukou nástroj s obrovským potenciálem pro medicínu, vzdělávání, design rozhraní i třeba personalizaci médií.

Meta to celé zveřejnila. Zadarmo.

Model, zdrojový kód, výzkumný článek i interaktivní demo. Vše pod licencí CC BY-NC 4.0, tedy volně dostupné pro nekomerční použití. Na GitHubu má repozitář už přes 1 100 hvězdiček, na Hugging Face si kdokoliv může stáhnout váhy modelu.

Jeden podnikavý vývojář dokonce TRIBE v2 přetvořil na SEO nástroj, který míří na předpovědi, které části webové stránky přitáhnou pozornost lidského mozku. Zní to šíleně? Možná. Ale ukazuje to, kam se taková technologie může dostat, když ji vypustíte do volného prostoru.

A tak zatímco se většina pozornosti točí kolem jazykových modelů a generátorů obrázků, Meta potichu postavila něco, co míří mnohem hlouběji. Přímo k tomu, jak funguje lidské vnímání. A jestli se tahle cesta ukáže jako průchodná, půjde o jeden z nejzajímavějších pokusů propojit umělou inteligenci s tou biologickou, kterou nosíme v hlavě.