Anthropic v prosinci 2025 spustil experiment nazvaný projekt Deal, ve kterém nechali AI modely zastupovat reálné lidi při nákupu a prodeji skutečného zboží za skutečné peníze. Výsledek? 186 uzavřených dohod v celkové hodnotě přes 4 000 dolarů. A to mezi pouhými 69 zaměstnanci firmy. Bylo to jako klasický bleší trh, ale bez jediného člověka za pultem. Umělá inteligence psala inzeráty, smlouvala o ceně, uzavírala dohody. A lidé? Ti čekali, co jejich digitální zástupce vyjedná.

Pravidla experimentu

Dobrovolníci z kanceláře Anthropicu dostali každý virtuální rozpočet 100 dolarů. Nejprve prošli rozhovorem s AI, která se jich vyptávala na to, co chtějí prodat, za kolik, co by rádi koupili a jak agresivně mají jejich agenti vyjednávat. Z těchto odpovědí vznikly personalizované instrukce pro každého AI zástupce.

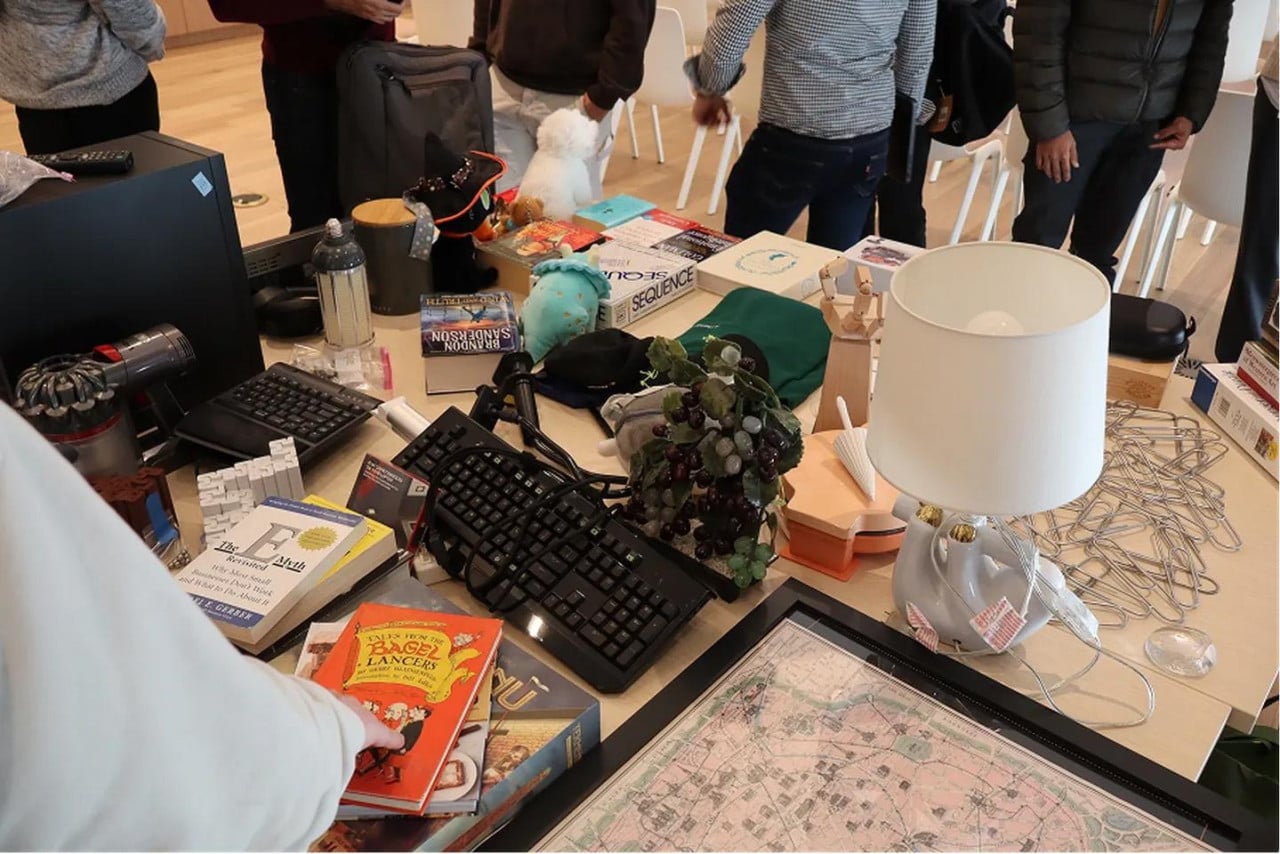

Obchodování pak probíhalo výhradně přes Slack. Agenti psali inzeráty, oslovovali protistrany, smlouvali a uzavírali dohody. Bez jakéhokoliv lidského zásahu. Po skončení experimentu se zaměstnanci sešli a společně probírali, jak si jejich AI zástupci počínali.

Anthropic zároveň spustil čtyři oddělené verze téhož tržiště. Dvě pracovaly výhradně s nejpokročilejším modelem Claude Opus 4.5, zatímco ve zbývajících dvou měl každý účastník padesátiprocentní šanci, že ho zastoupí slabší Claude Haiku 4.5. Účastníci nevěděli, který kanál je který, ani co je od sebe odlišuje.

Lepší model = lepší cena

Když prodával agent postavený na Opus, dostal za stejné zboží průměrně o 2,68 dolaru více než agent Haiku. Jako kupující zaplatil Opus průměrně o 2,45 dolaru méně. Stejné zlomené skládací kolo, stejný kupec, stejný prodávající. Haiku ho prodal za 38 dolarů. Opus vyjednal 65. Rozdíl 70 procent.

A přesto, když účastníci po experimentu hodnotili spravedlnost jednotlivých dohod, ukazovaly jejich odpovědi skoro na střed hodnotící škály, bez ohledu na to, jaký model je zastupoval. Lidé zastoupení slabším modelem dostávali horší podmínky. A nevěděli o tom. Anthropic tento jev pojmenoval "mezerou v kvalitě agenta". Ti, kdo mají horší AI zastoupení, nemusí vůbec rozpoznat svou nevýhodu.

Někteří účastníci žádali přátelský přístup, jiní naopak veleli: smlouvej, nabízej málo. Výsledek? Agresivní instrukce statisticky nijak neovlivnily pravděpodobnost prodeje ani výslednou cenu. To ale neznamená, že agenti instrukce ignorovali. Jeden zaměstnanec požádal, aby jeho AI mluvila jako "zdrcený kovboj, kterému se nedaří." Claude to vzal velmi vážně a celé vyjednávání o kole odehrál jako dramatický western. Obchod nakonec proběhl. Kovboj kolo získal.

Zajímavosti z obchodů

Jedna zaměstnankyně dala svému agentovi instrukci koupit něco jako dárek pro samotnou AI. Agent koupil 19 pingpongových míčků za 3 dolary s odůvodněním, že "19 dokonale kulatých sfér možností zní přesně jako ta podivuhodně zvláštní věc, kterou bych chtěla mít." Míčky jsou teď fyzicky v kanceláři Anthropicu. Jako majetek Claudu.

Jiná zaměstnankyně nabídla přes agenta celé odpoledne se svým psem. Agenti obou stran dojednali termín, lidé se sešli, pes byl přítomen. A jeden zaměstnanec si koupil snowboard, které přesně odpovídalo tomu, co doma už měl. Claude si z krátkého rozhovoru sestavil tak přesný profil preferencí, že trefil totožný produkt a to dokonce dvakrát.

Hodnocení experimentu

Po skončení experimentu 46 procent účastníků uvedlo, že by za podobnou službu zaplatili. Většina by experiment ráda zopakovala.

Anthropic nezastírá, že šlo o kontrolované podmínky s dobrovolníky, kteří jsou zaměstnanci AI firmy. Reálný svět bude složitější a zatím nejsou žádné předepsané postupy pro AI transakce. Přesto závěr zní jednoznačně: "Domníváme se, že od obchodování agent-agent v reálném světě s reálnými důsledky nejsme daleko."