Co potřebujete k tomu, abyste vytvořili klon populárního AI chatbotu? Překvapivě nemusíte být zkušený hacker. Stačí vám totiž správně položit zhruba 100 000 dotazů. Ano, přesně tolik jich potřebovali útočníci, kteří se pokusili rozebrat Gemini na součástky a sestavit jeho kopii. Google však celou akci odhalil a o nebezpečí takzvaných destilačních útoků varoval na svém blogu.

Co jsou destilační útoky a k čemu slouží

Výzkumné a bezpečnostní oddělení Googlu (Google Threat Intelligence Group) zveřejnilo v letošním únoru zprávu, která shrnuje AI hrozby v posledním čtvrtletí roku 2025. Mezi ostatními způsoby zneužití AI se objevují právě tzv. destilační útoky, se kterými se potýkají všechny velké jazykové modely.

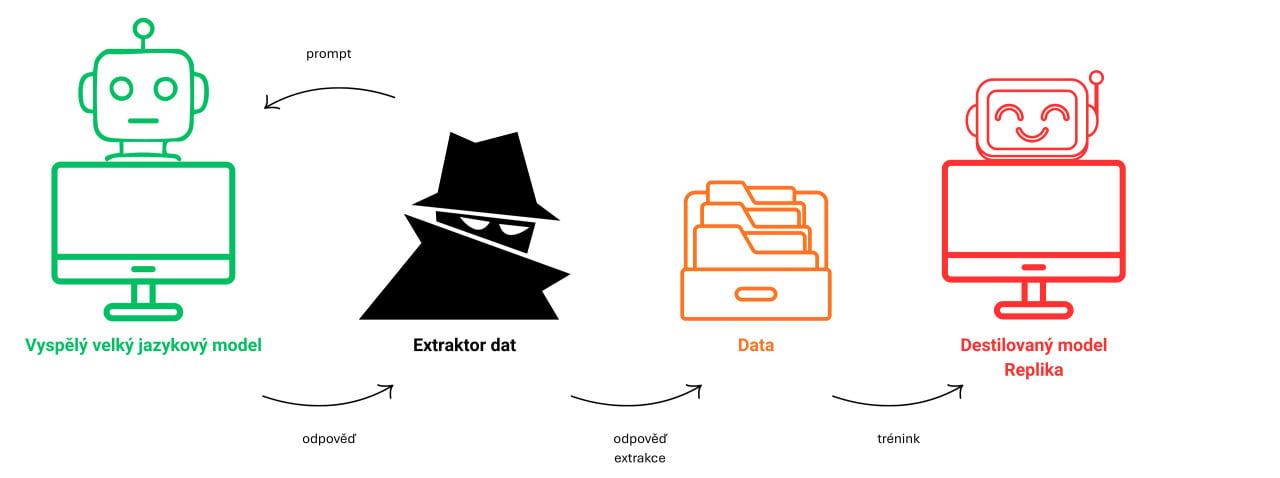

Při takovém druhu zneužití AI útočníci opakovaně pokládají modelu dotazy a sbírají a analyzují jeho odpovědi, aby na jejich základě vytrénovali vlastní konkurenční produkt. A celý takový proces probíhá vlastně naprosto snadno, a to přes veřejně přístupné rozhraní. Díky tomu tak hackeři dokáží vytvořit vlastní jazykový model, aniž by investovali roky času a miliardy do vlastního tréninku.

Tato destilace schopností a znalostí z vyspělejšího rozsáhlého jazykového modelu však přestavuje zásadní problém. Velké společnosti stojí trénink jejich špičkových modelů miliardy dolarů a programování jejich vnitřní logiky je specifické know-how, které zkrátka nesmíte jen tak odcizit.

Akce o 100 000 dotazech

Destilační útoky nejsou ve světě umělé inteligence nic nového, a i Gemini tuto taktiku zná. Při této větší akci byl však zasypán více než 100 000 prompty. Na základě těchto párů otázek a odpovědí se extraktoři dat snažili vytvořit AI klon, který by kopíroval vlastnosti Gemini. Google však nakonec problém identifikoval a upravil obranu modelu.

Útočníci se navíc nezaměřili jen na jednoduchý proces otázek a odpovědí. Zamířili na velmi konkrétní cíl, kterým je Geminiho schopnost řetězového uvažování (chain-of-thought process) a pokročilého zdůvodňování. A záměr byl jasný – útočníci zřejmě chtěli rozkrýt systém, jakým tato AI řeší víceúrovňové problémy a dotazy. Tento „tok myšlenek“ totiž bývá běžně skrytý a právě přes 100 000 dotazů se útočníci snažili velký jazykový model přimět, aby odhalil, jak přemýšlí, což by posloužilo jako tréninkový materiál pro vývoj repliky.

Společnost Google uvedla, že útoky odhalila v reálném čase. Kdo za nimi však stojí firma nijak nekomentovala. Mluvčí Googlu NBC News sdělil, že dotazy mířily z různých koutů světa.

Varování pro menší AI firmy

John Hultquist, hlavní analytik GTIG, NBC News dále sdělil, že Gemini je pouze první vlaštovka a varuje, že oběťmi podobných útoků se mohou stát také menší firmy s vlastními AI nástroji. Hovoří mimo jiné i o tom, že u menších firem se navíc bude dát ukrást celé know-how jejich fungování, a to z důvodu, že AI nástroje plní skutečnými a praktickými daty. Tyto znalosti pak nebude pro útočníky těžké „vydestilovat“.

Gemini není první obětí

Destilační útoky se podle technologického informačního webu Ars Technica využívají přinejmenším od éry GPT-3. Mezi nejznámější případy patří loňská kauza, kdy společnosti OpenAI obvinila čínský DeepSeek, že touto metodou vylepšoval své vlastní modely.

Podobnému obvinění čelila v roce 2023 také společnost xAI s jejich modelem Grok. Ten totiž v určitých situacích citoval ze „zásad používání OpenAI“. I když se vývojáři bránili, že se jedná o náhodné načtení podmínek, mnoho uživatelů si všimlo, že chatbot reagoval dost podobně jako ChatGPT, a podobností tak šlo nalézt skutečně více.

Google vrací úder a zlepšuje bezpečnost

Protože jsou útoky na AI čím dál častější, Google je v obraně svých jazykových modelů velmi aktivní. Okamžitě proto nejen zablokoval účty spojené s útoky, ale také veškerá nasbíraná data z destilačního útoku ihned použil k přímému posílení obrany a lepší klasifikaci hrozeb.

Gemini je tak nyní trénován, aby rozpoznával, kdy je systematicky „těžen“ pro svou vnitřní logiku a učí se rozpoznávat prompty, které jsou součást destilační kampaně. Pro útočníky tak snad v budoucnu bude „sondování“ u konkurence čím dál složitější.