Gemini Robotics 1.5: Nová generace robotů, kteří myslí a jednají

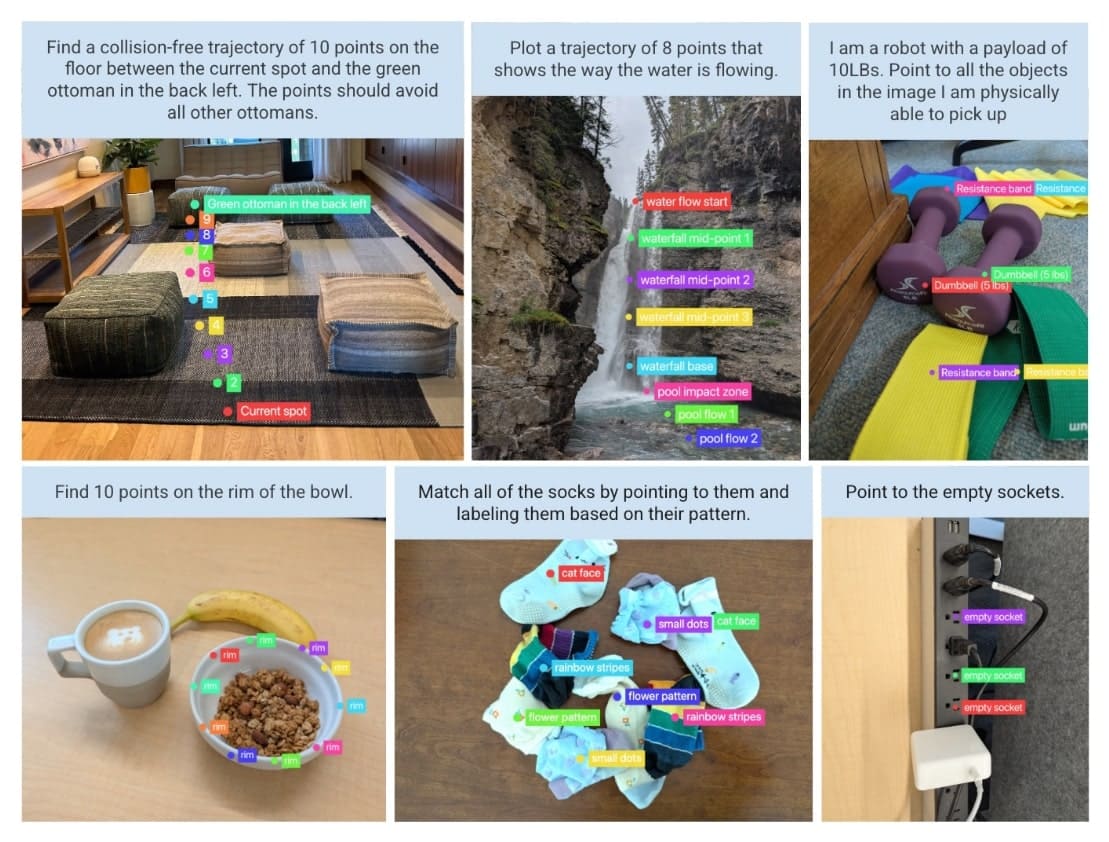

Představte si robota, který nejen vidí svět kolem sebe, ale i plánuje, co udělá dál, a vysvětluje své rozhodnutí slovy. Právě to umožňuje nový model Gemini Robotics 1.5 od Google DeepMind, který vyšel 25. září 2025. Tento model vidění-jazyk-akce (VLA) bere vizuální informace a slovní pokyny a převádí je přímo na pohyby robota. Například, když robot dostane úkol roztřídit prádlo podle barev, nejdřív si to promyslí – bílé do bílého koše, barevné do černého – a pak teprve začne pohybovat rukama, aby to provedl. To všechno díky schopnosti modelu generovat vnitřní řetězec myšlenek v přirozeném jazyce, což dělá celý proces průhlednější.

Model spolupracuje s dalším, nazvaným Gemini Robotics-ER 1.5, který funguje jako mozek na vyšší úrovni. Tento model vidění-jazyk (VLM) se specializuje na plánování a logické rozhodování v reálném prostředí. Dokáže volat digitální nástroje, jako je Google Search, aby získal potřebné informace – třeba místní pravidla pro třídění odpadu. Potom pošle přesné instrukce modelu Gemini Robotics 1.5, který je promění v konkrétní akce. Oba modely jsou postavené na základě rodiny modelů Gemini a vyladěné na specifických datech, což jim umožňuje zvládat delší úkoly v různých prostředích.

Myšlení před každým pohybem

Jedna z největších výhod Gemini Robotics 1.5 spočívá v tom, že robot přemýšlí, než se pohne. Při úkolu jako "roztřiď moje prádlo podle barev" model nejdřív analyzuje situaci: chápe, že bílé patří do jednoho koše a barevné do druhého. Pak si naplánuje pohyby, například vzít červený svetr a položit ho do černého koše, a dokonce zváží detaily, jako posunout svetr blíž pro snazší uchopení. Tento proces dělí složité úkoly na jednodušší části, což pomáhá robotovi zvládat nové situace a být odolnější vůči změnám v okolí.

Díky této schopnosti se robot stává flexibilnějším. Například při třídění objektů do kompostu, recyklace a odpadu nejdřív zjistí místní pravidla přes internet, prohlédne předměty před sebou a pak je roztřídí. To všechno bez nutnosti přesných příkazů od člověka – stačí obecný požadavek.

Učení přes různé typy robotů

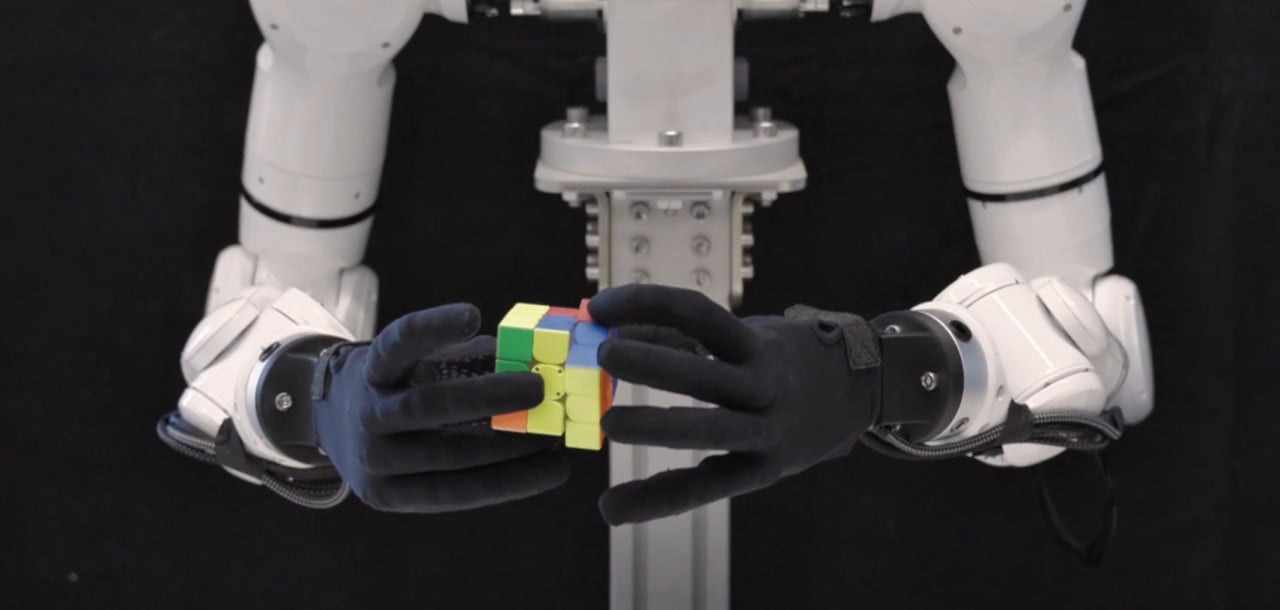

Gemini Robotics 1.5 dokáže přenášet naučené dovednosti mezi různými roboty, což je obrovský pokrok. Pokud se model naučí úkol na robotu ALOHA 2 s dvěma rameny, stejný pohyb funguje i na humanoidním robotu Apollo od firmy Apptronik nebo na bi-arm robotu Franka. To znamená, že není potřeba model upravovat pro každý nový typ robota – dovednosti se přenáší přímo, což urychluje učení a dělá roboty univerzálnějšími.

Tento přístup vychází z tréninku na datech z různých robotů, což umožňuje generalizaci. Například úkoly trénované jen na ALOHA 2 fungují okamžitě na Apollu nebo Frankovi, a naopak.

Bezpečnost a dostupnost pro vývojáře

Bezpečnost je klíčová, a proto model Gemini Robotics 1.5 zahrnuje myšlení o bezpečnosti před každou akcí, respektování dialogu s lidmi podle zásad Gemini a aktivaci systémů proti kolizím na robotovi. Google DeepMind vylepšil benchmark ASIMOV pro hodnocení bezpečnosti, který teď zahrnuje lepší pokrytí okrajových případů, anotace a nové typy otázek i videí. Model Gemini Robotics-ER 1.5 dosáhl v těchto testech špičkových výsledků.

Od 25. září 2025 je Gemini Robotics-ER 1.5 dostupný pro vývojáře přes Gemini API v Google AI Studio. Plná verze Gemini Robotics 1.5 je zatím pro vybrané partnery. Podrobnosti o stavbě s těmito modely najdete na blogu pro vývojáře.

Tento vývoj přináší roboty blíž k tomu, aby pomáhali v každodenním životě – od úklidu po složité úkoly v průmyslu. S Gemini Robotics 1.5 se umělá inteligence stává součástí fyzického světa, kde roboti nejen reagují, ale i aktivně přemýšlejí a plánují.