Wan 2.2: AI generování videa od laboratoře Tongyi Lab

Společnost Alibaba Group prostřednictvím svého výzkumného střediska Tongyi Lab představila zcela novou generaci modelu pro generování videí s názvem Wan 2.2. Tento pokrok v oblasti umělé inteligence je nabízen jako open source řešení dostupné po celém světě včetně České republiky.

Technické inovace a architektura MoE

Wan 2.2 přináší převratnou architekturu nazvanou Mixture-of-Experts (směs expertů), která dosud nebyla v modelech pro generování videa použita. Tato architektura rozděluje proces odšumování (denoising) napříč časovými kroky pomocí specializovaných expertních modelů. Konkrétně model využívá dva odborné systémy: vysokošumový expert pro počáteční fáze zaměřující se na celkové rozvržení a nízkošumový expert pro pozdější fáze, který dolaďuje detaily videa.

Každý expertní model obsahuje přibližně 14 miliard parametrů, což v součtu činí 27 miliard parametrů, přičemž v každém kroku je aktivních pouze 14 miliard. Toto řešení výrazně zvyšuje celkovou kapacitu modelu při zachování stejných výpočetních nákladů jako u předchozích verzí.

Datový základ a výkonnost

Ve srovnání s předchozím modelem Wan 2.1 byl model Wan 2.2 trénován na výrazně větším datasetu obsahujícím o 65,6 % více obrázků a o 83,2 % více videí. Toto rozšíření výrazně zlepšuje schopnost modelu generalizovat napříč mnoha dimenzemi včetně pohybů, sémantiky a estetiky.

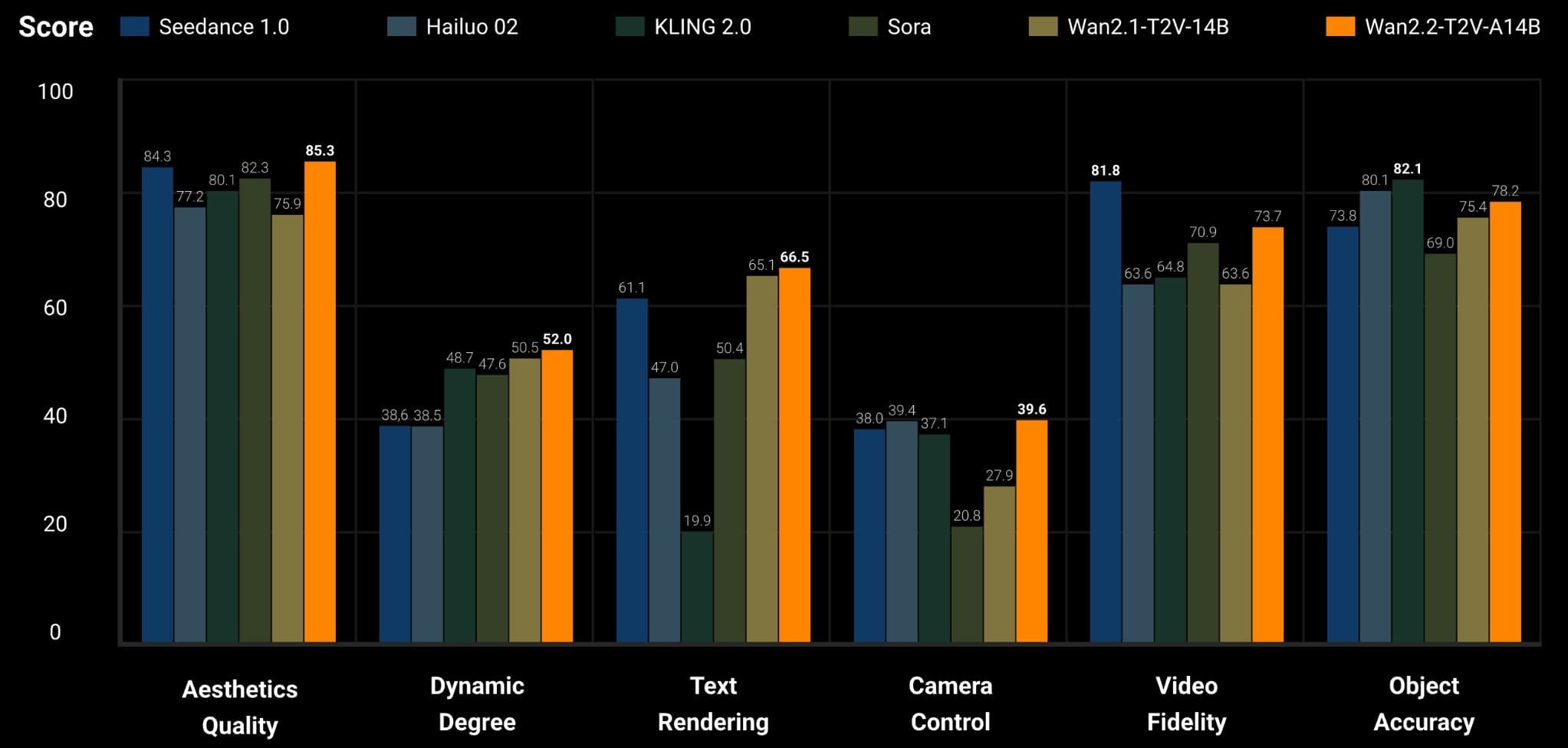

Na novém benchmarku Wan-Bench 2.0 překonává model Wan 2.2 vedoucí komerční modely ve většině klíčových evaluačních dimenzí. Model dosahuje nejlepší výkonnosti mezi všemi open source i komerčními modely v oblasti generování videa.

Kinematografická kontrola a kreativní možnosti

Wan 2.2 nabízí profesionální kinematografické vyprávění prostřednictvím hlubokého ovládání filmového jazyka. Model poskytuje jemnou kontrolu nad osvětlením, barvami a kompozicí pro všestranné styly s citlivými detaily. Uživatelé mohou vytvářet komplex pohybové sekvence s vylepšenou plynulostí a kontrolou.

Model dokáže zpracovat složité scény s více objekty a přesně následovat detailní instrukce. Mezi příklady patří generování dynamických hip-hopových tanečních scén, bojových sekvencí, parkourových akcí nebo akrobatických výkonů na letadle ve vzduchu.

Tři hlavní varianty modelu

Wan AI vydalo tři hlavní varianty modelu Wan 2.2:

Wan 2.2-T2V-A14B je model pro převod textu na video podporující generování 5sekundových videí v rozlišení 480P i 720P. Je postaven s architekturou Mixture-of-Experts a dosahuje vynikající kvality generování videa.

Wan 2.2-I2V-A14B je navržen speciálně pro generování videa z obrázku a podporuje rozlišení 480P i 720P. Díky architektuře MoE dosahuje stabilnější syntézy videa se sníženými nerealistickými pohyby kamery a nabízí vylepšenou podporu pro rozmanité stylizované scény.

Wan 2.2-TI2V-5B je hybridní model postavený s pokročilým Wan 2.2-VAE, které dosahuje kompresního poměru 16×16×4. Tento model podporuje generování textu na video i obrázku na video v rozlišení 720P s 24 snímky za sekundu a může běžet na jednotlivých spotřebitelských GPU jako je NVIDIA 4090.

Dostupnost v České republice

Model Wan 2.2 je jako open source řešení dostupný po celém světě včetně České republiky bez jakýchkoliv regionálních omezení. Čeští uživatelé mohou model stáhnout a spustit prostřednictvím platforem GitHub, Hugging Face a ModelScope. Model je také dostupný online prostřednictvím Hugging Face Space, kde je možné testovat TI2V-5B model.

Pro lokální spuštění je potřeba hardware schopný podporovat PyTorch 2.4.0 a vyšší verze s dostatečnými výpočetními zdroji. Model TI2V-5B dokáže bez specifické optimalizace vygenerovat 5sekundové video v rozlišení 720P za méně než 9 minut na jednom spotřebitelském GPU.

Cenová politika a předplatné

Základní verze zdarma: Model Wan 2.2 v základní open source verzi je zcela zdarma pro osobní i komerční použití. Uživatelé mohou kód a modely stahovat z GitHub, Hugging Face a dalších platforem bez poplatků.

Wan 2.2 Plus: Pro pokročilé funkce, nástroje a šablony existuje placená verze "Wan 2.2 Plus" dostupná přes oficiální web WanVideo.

Náklady na hardware: Jediné náklady, které mohou vzniknout, jsou náklady na výpočetní hardware nebo využití cloudových GPU služeb, které nejsou stanoveny společností Wan AI.

WanBox - komplexní kreativní platforma

Wan AI nabízí také kreativní platformu WanBox, která umožňuje spouštět různé kreativní úlohy včetně generování obrázků, generování videa a editace videa. Platforma nabízí flexibilní editaci videí pomocí časové osy pro střih klipů a další generování obsahu.