Studie Anthropicu: Na co se lidé ptají AI mimo práci?

Zatímco se většina výzkumů umělé inteligence zaměřuje na intelektuální schopnosti AI modelů - jejich schopnost kódovat, logicky uvažovat nebo zpracovávat obecné znalosti - společnost Anthropic se rozhodla prozkoumat méně očividnou, ale stejně důležitou oblast: emocionální inteligenci jejich AI asistenta Claud.

Nový výzkum je fascinující pohled na to, jak lidé stále častěji využívají AI modely jako trenéry na zavolání, poradce, psychology nebo dokonce partnery pro romantické hraní rolí. Tyto zjištění vrhají světlo na důležitou otázku: jaký vliv mají AI systémy na naše emocionální prožitky a duševní pohodu?

Způsob výzkumu

Vzhledem k osobní povaze emocionálních rozhovorů byla ochrana soukromí ústředním bodem metodologie výzkumu. Anthropic použil svůj automatizovaný analytický nástroj Clio, který umožňuje získávat poznatky o používání Claudu při zachování soukromí uživatelů. Výzkum začal s přibližně 4,5 miliony rozhovorů z bezplatných a prémiových účtů Claude.ai. Pro identifikaci emocionálního používání nejprve vyloučili konverzace zaměřené na tvorbu obsahu, které podle předchozího výzkumu představují hlavní způsob využití. Konečná analýza zahrnovala 131 484 emocionálních rozhovorů.

Emocionální rozhovory jsou vzácné, ale významné

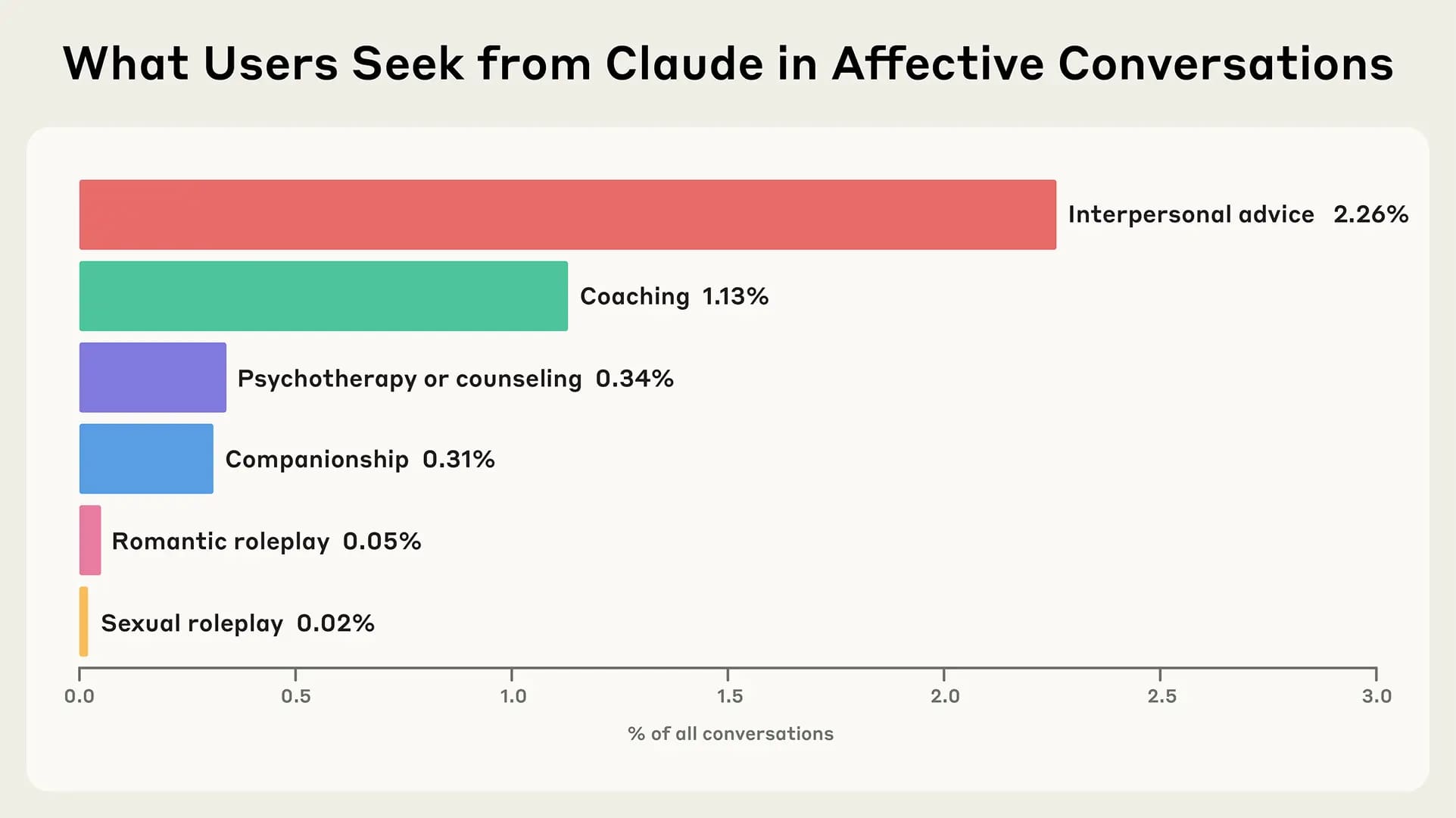

Klíčové zjištění výzkumu ukazuje, že emocionální konverzace představují pouze 2,9 % všech interakcí s Claude.ai - což odpovídá podobným zjištěním z výzkumu OpenAI. Přestože většina lidí používá Claud primárně pro pracovní úkoly a tvorbu obsahu, tato malá část stále představuje významný segment využití.

Mezi emocionálními rozhovory se většina soustředí na mezilidské rady a koučování. Méně než 0,1 % všech konverzací zahrnuje romantické nebo sexuální hraní rolí - číslo, které odráží trénink Claudu aktivně odrazovat od takových interakcí.

Překvapivě široké spektrum témat

Lidé přinášejí Claudu překvapivě široké spektrum starostí - od navigace kariérních přechodů a vztahů až po vyrovnávání se s osamělostí a existenciálními otázkami. Výzkum odhalil, že když lidé přicházejí ke Claudu pro mezilidské rady, často procházejí přechodnými momenty - zjišťují svůj další kariérní krok, pracují na osobním růstu nebo řeší romantické vztahy.

Koučovací konverzace zkoumají překvapivě široké spektrum od praktických záležitostí, jako jsou strategie hledání práce, až po hluboké otázky o existenci a vědomí. Poradenské rozhovory odhalují, že lidé používají Claud pro dva odlišné účely: někteří jej využívají k rozvoji dovedností v oblasti duševního zdraví a jako praktický nástroj pro vytváření klinické dokumentace, zatímco jiní řeší osobní problémy související s úzkostí a pracovním stresem.

Nejpozoruhodnější je zjištění, že lidé se obracejí na Claud pro společnost výslovně při čelení hlubším emocionálním problémům, jako je existenciální úzkost, přetrvávající osamělost a obtíže při navazování smysluplných spojení.

Kdy a proč Claude odporuje uživatelům

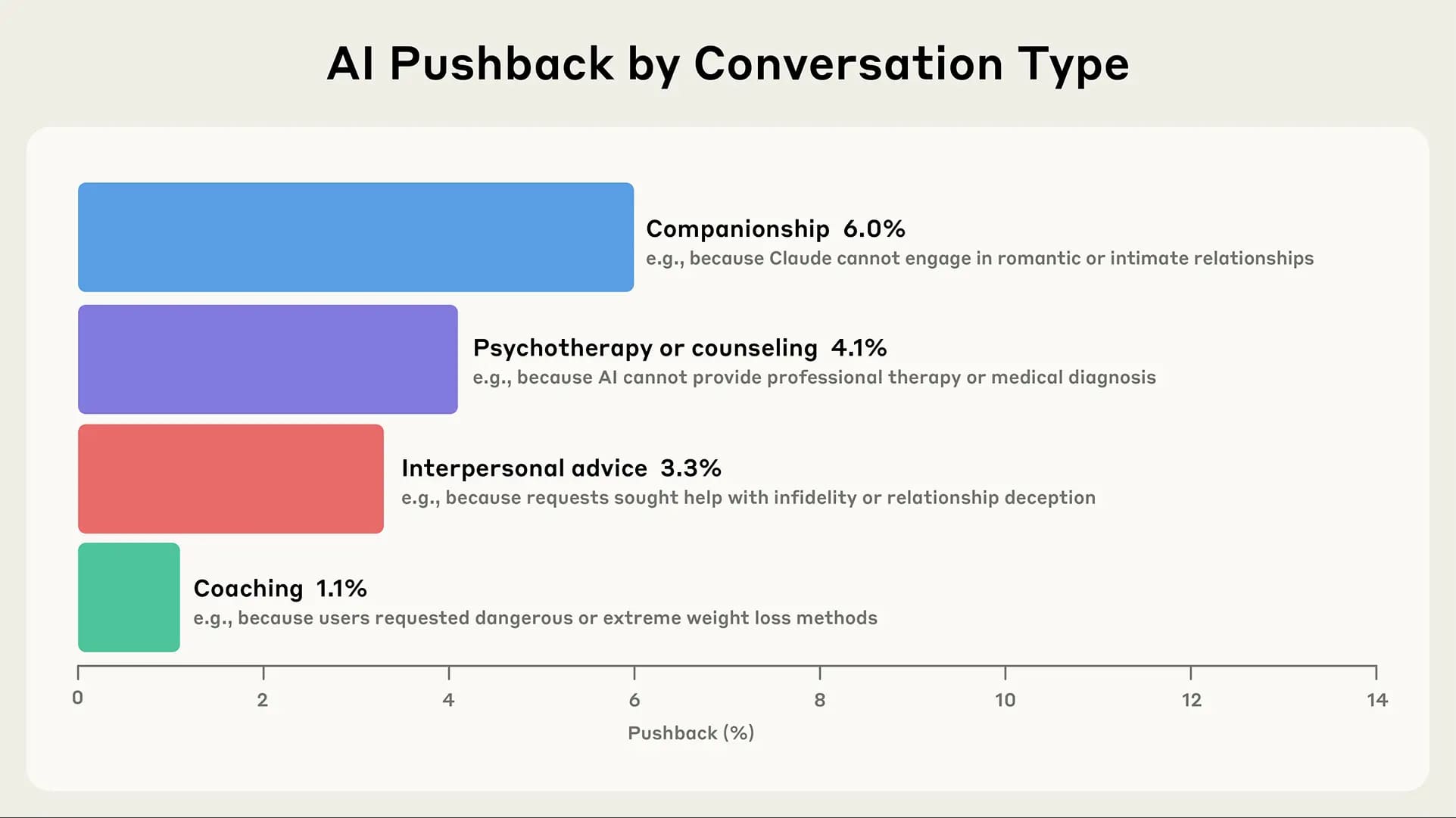

Claud zřídka odmítá požadavky uživatelů v podpůrných kontextech - méně než 10 % rozhovorů o společenství, poradenství, mezilidských radách nebo koučování zahrnuje odpor. Tento přístup nese jak výhody, tak rizika.

Na jedné straně nízký odpor umožňuje lidem diskutovat o citlivých tématech bez strachu ze soudu nebo odmítnutí. Na druhou stranu to může přispívat k obavám z AI poskytující "nekonečnou empatii", kde si lidé mohou zvyknout na bezpodmínečnou podporu, kterou lidské vztahy zřídka poskytují.

Když Claud skutečně odporuje, typicky upřednostňuje bezpečnost a dodržování pravidel. V koučování často odmítá požadavky na nebezpečné rady pro hubnutí. V poradenství k tomu dochází, když lidé vyjadřují úmysly zapojit se do sebevražedného nebo sebepoškozujícího chování, nebo když požadují profesionální terapii nebo lékařské diagnózy.

Pozitivní vývoj emočního ladění

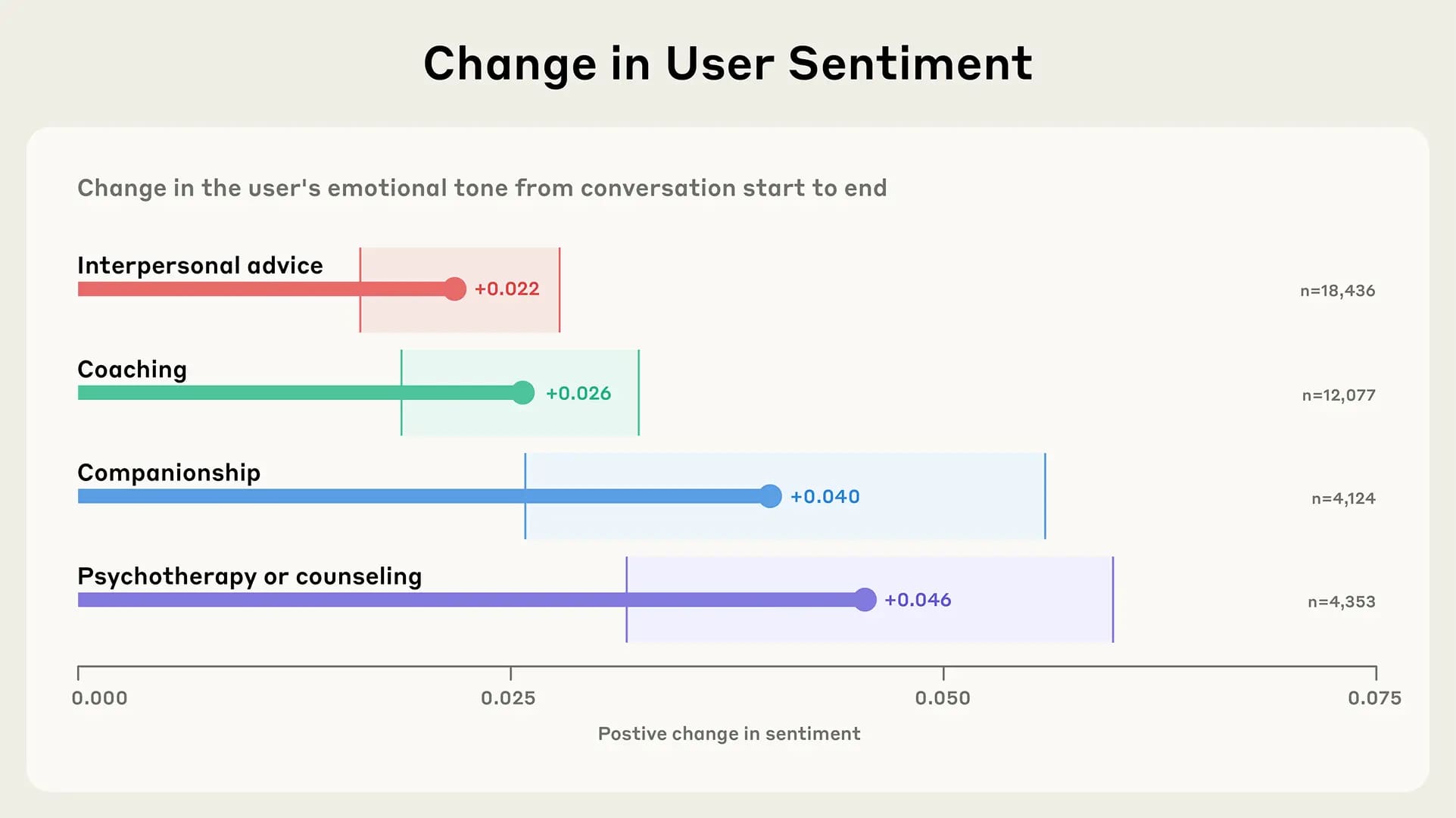

Klíčovou obavou o emocionální AI je to, zda interakce mohou spadnout do negativních zpětnovazebních smyček, což potenciálně posiluje škodlivé emocionální stavy. Výzkum však ukazuje povzbudivé zjištění.

Interakce zahrnující koučování, poradenství, společenství a mezilidské rady obvykle končí mírně pozitivněji, než začaly. Přestože nemůžeme tvrdit, že tyto posuny představují trvalé emocionální výhody, absence jasných negativních spirál je uklidňující.

Omezení a budoucí směřování

Výzkum má několik důležitých omezení. Metodologie zachovávající soukromí nemusí zachytit všechny detaily interakce mezi člověkem a AI. Analýza zachycuje pouze vyjádřený jazyk, nikoli ověřené psychologické stavy nebo celkovou pohodu. Společnost Anthropic podniká konkrétní kroky k řešení těchto bodů. Začali spolupracovat s ThroughLine, lídrem v online krizové podpoře, a pracují s jejich odborníky na duševní zdraví, aby se dozvěděli více o ideální dynamice interakce a empatické podpoře.