Meta přišla s aktualizací, která potěší každého, kdo pracuje s počítačovým viděním. SAM 3.1, nejnovější verze modelu Segment Anything, přináší zásadní zlepšení ve zpracování videa bez toho, aby bylo potřeba přepisovat celý pracovní postup. Jde totiž o přímou náhradu předchozí verze SAM 3.

Ale co to vlastně SAM je? Zkratka stojí za Segment Anything Model, tedy model, který dokáže v obraze nebo videu najít, ohraničit a sledovat jakýkoliv objekt. Ať už jde o člověka, deštník, nebo třeba ptakopyska.

Nový trik zvaný multiplexing

Předchozí verze modelu zpracovávala každý sledovaný objekt zvlášť, jeden po druhém. To bylo pomalé a zbytečně náročné na výpočetní výkon.

SAM 3.1 zavádí takzvaný object multiplexing, tedy techniku, díky níž model zpracuje až 16 objektů najednou v jediném průchodu. Výsledek? Propustnost videa se na jediném grafickém čipu H100 zdvojnásobila, z 16 na 32 snímků za sekundu. A to při sledování většího počtu objektů současně.

Z toho plyne, že sledování v reálném čase ve složitých záběrech s mnoha pohybujícími se prvky, které dřív vyžadovalo drahý a výkonný hardware, se teď dá zvládnout na výrazně skromnějších strojích. To je pro vývojáře a menší týmy podstatná věc.

Co uměl dřívější model SAM 3?

Aby bylo jasné, co SAM 3.1 zdědil, je dobré říct, čím SAM 3 zaujal od svého prvního vydání. SAM 3 je unifikovaný model pro detekci, segmentaci a sledování objektů v obrázcích i videu. Přijímá textové pokyny (třeba "pruhovaný červený deštník"), vzorové obrázky i vizuální vodítka jako masky nebo body. To ho výrazně odlišuje od starších modelů, které fungovaly jen s pevně daným seznamem kategorií.

Model dokáže segmentovat obrovské množství konceptů díky tomu, že Meta vybudovala datový stroj kombinující lidské zpracovatele dat a AI modely. Ten přinesl více než 4 miliony unikátních konceptů v trénovacích datech. Označování dat probíhalo přibližně 5x rychleji než čistě lidskou prací u negativních příkladů a o 36 % rychleji u těch obtížnějších.

Meta při stavbě SAM 3 nestavěla od nuly. Model stojí na několika ověřených součástech. Textový a obrazový enkodér pochází z Meta Perception Encoder, otevřeného modelu, který Meta sdílela v dubnu předchozího roku. Detektor navazuje na model DETR, první systém používající transformery pro detekci objektů. Paměťová banka vychází z předchozí generace modelu SAM 2.

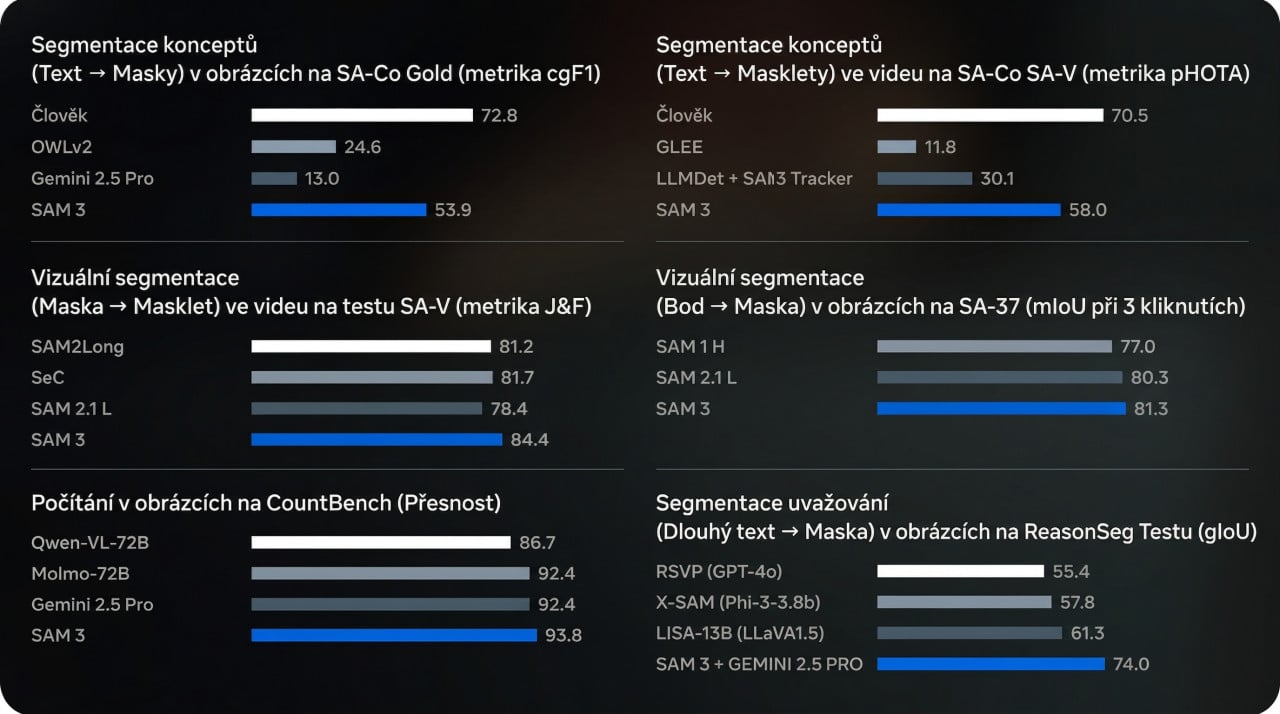

Výsledkem je systém, který v benchmarcích překonává jak velké jazykové modely jako Gemini 2.5 Pro, tak specializované nástroje jako OWLv2 nebo GLEE. Uživatelé při testech preferovali výstupy SAM 3 před OWLv2 v poměru přibližně tři ku jedné.

Kde se takový model používá?

Výzkumné výsledky jsou pěkné, ale co praxe? Meta model nezamkla do laboratoře. Na Facebooku Marketplace SAM 3 pohání funkci "Zobrazit v pokoji", která lidem umožňuje virtuálně umístit kus nábytku do jejich prostoru dřív, než ho koupí. Je takovým "IKEA efektem" pro online nakupování.

V aplikaci Edits, Instagramovém nástroji pro tvorbu videí, přibydou brzy efekty postavené na SAM 3. Tvůrci budou moct jedním klepnutím aplikovat dynamické efekty na konkrétní osobu nebo objekt ve videu. To, co dřív trvalo hodiny ve střižně, zvládne model za vteřiny.

Meta spolupracovala také s organizacemi Conservation X Labs a Osa Conservation na vytvoření veřejně dostupného datového souboru pro sledování divoké přírody. Soubor SA-FARI obsahuje přes 10 000 videí z fotopastí s více než 100 druhy zvířat, opatřených ohraničovacími rámečky a segmentačními maskami pro každé zvíře v každém snímku. Tohle je přesně ten typ využití, který dává celé práci kolem AI smysl.

Co se dá ještě zlepšit

Bylo by nefér tvrdit, že SAM 3.1 zvládne všechno. Model zatím obtížně rozpoznává specializované pojmy vyžadující odborné znalosti, jako třeba "krevní destička" v lékařském snímku. Funguje výborně s krátkými obecnými popisy, ale složitější instrukce jako "druhá kniha zprava na horní polici" ho zatím přesahují.

Meta otevřeně říká, že model se rychle přizpůsobí novým konceptům při doladění na malém množství dat. Kód pro doladění modelu je součástí veřejného vydání, takže výzkumná komunita a firmy mohou SAM 3.1 přizpůsobit svým specifickým potřebám. Spolupráce s platformou Roboflow navíc umožní označovat data, doladit model a nasadit ho do praxe bez hlubokých technických znalostí.

Model i checkpoint SAM 3.1 jsou volně dostupné na HuggingFace a GitHubu, takže si je může prozkoumat a vyzkoušet kdokoliv.