Zajímá vás jak jazykové modely postupně formulují své odpovědi?

Nový výzkum společnosti Anthropic odhaluje fascinující pohled do "mysli" umělé inteligence

Když konverzujete s moderním chatbotem jako je Claude, ChatGPT nebo Gemini, možná máte dojem, že odpovědi vznikají okamžitě – jako by model prostě vygeneroval celou odpověď najednou. Nový průlomový výzkum společnosti Anthropic však ukazuje, že realita je mnohem složitější a překvapivě podobnější lidskému myšlení, než jsme si dosud mysleli.

Nahlédnutí do "mysli" AI

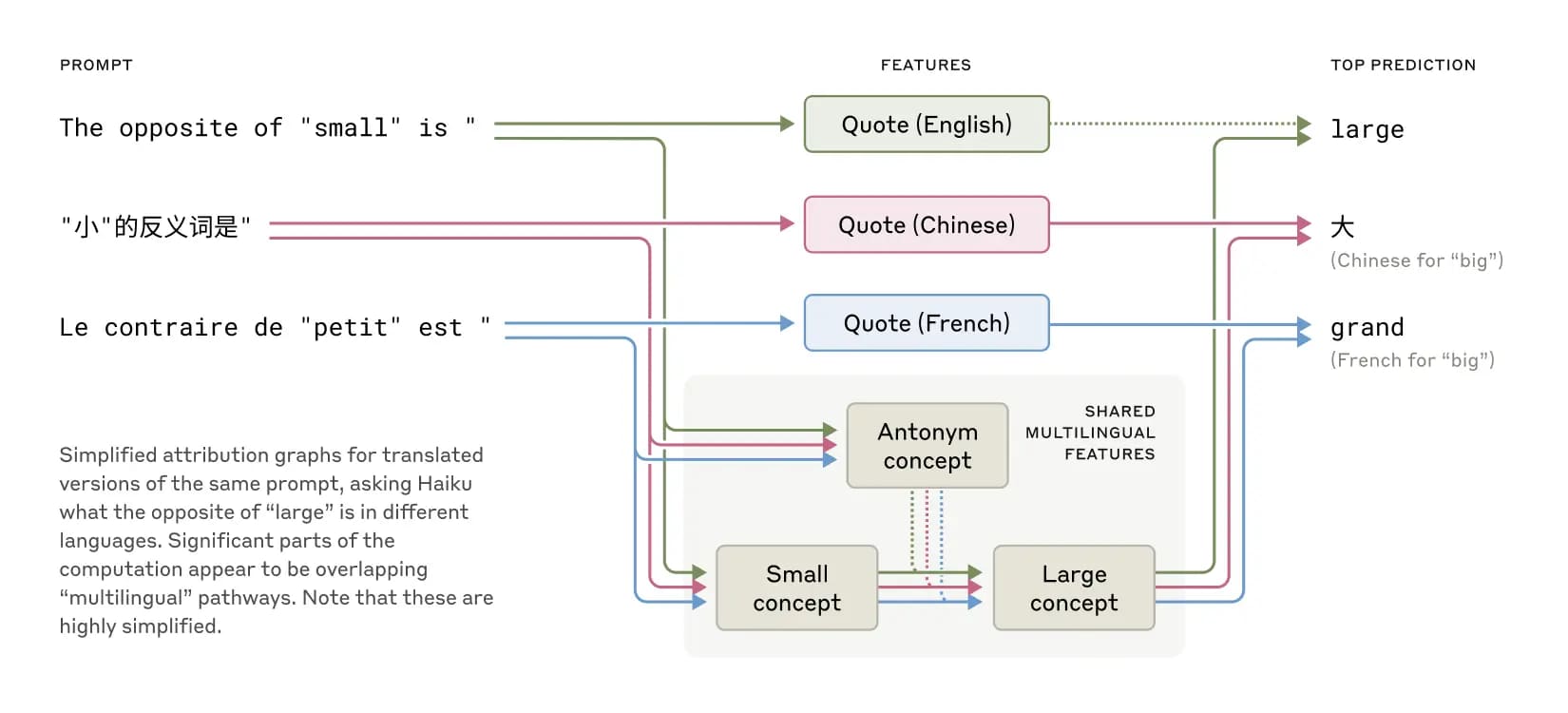

Výzkumníci z Anthropic vyvinuli inovativní metodu nazvanou "aktivační trasování" (activation tracing), která jim umožnila nahlédnout do vnitřních procesů jazykových modelů během generování odpovědí. Podobně jako když neurologové sledují aktivitu lidského mozku pomocí EEG nebo fMRI, tato metoda umožňuje vědcům pozorovat, jak se mění vnitřní reprezentace modelu během vytváření textu.

Výsledky jsou fascinující: jazykové modely nevytvářejí své odpovědi najednou, ale postupně je formulují v průběhu času. Informace o tom, co model plánuje říci později v odpovědi, je zakódována v jeho vnitřních vrstvách dlouho předtím, než jsou příslušná slova skutečně vygenerována.

Od myšlenky k textu

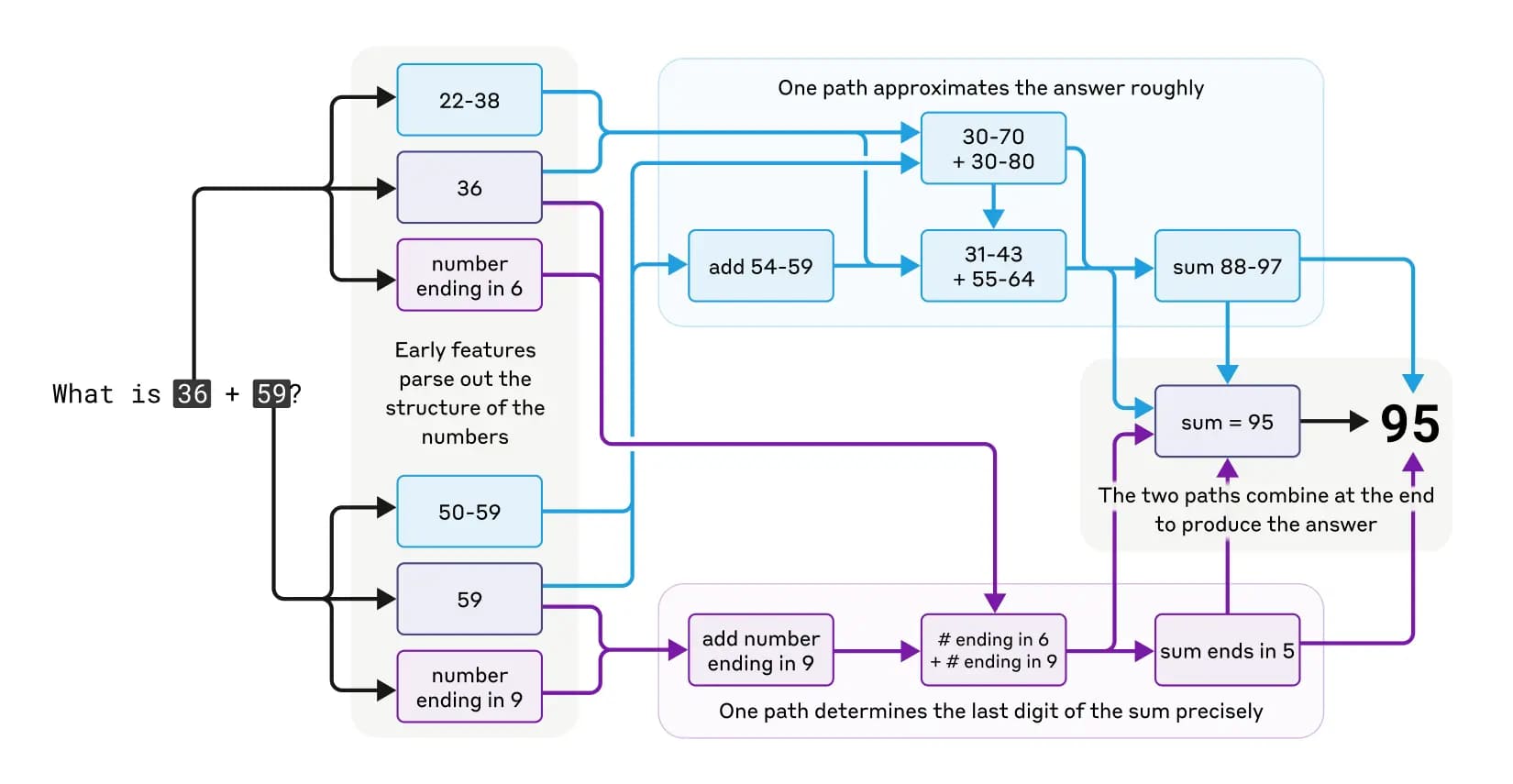

Jedním z nejzajímavějších zjištění je, že jazykové modely postupují při formulování odpovědí podobně jako lidé:

1. Nejprve vytvoří základní strukturu - model začíná s obecným rámcem a hlavními myšlenkami své odpovědi.

2. Postupně rozpracovává detaily - teprve poté model rozvíjí tyto hlavní myšlenky do konkrétních vět a formulací.

3. Dokončuje a dolaďuje odpověď - nakonec model upřesňuje detaily a zajišťuje, aby byla odpověď koherentní.

Tento proces je pozoruhodně podobný tomu, jak lidé přemýšlejí při sestavování složitějších odpovědí – nejprve máme obecnou představu o tom, co chceme říct, a teprve poté tuto myšlenku formulujeme do konkrétních slov a vět.

Architektonické detaily: Různé vrstvy, různé funkce

Výzkumníci zjistili, že různé vrstvy v architektuře modelu mají specializované funkce při generování odpovědí:

Střední vrstvy obsahují nejvíce informací o budoucích slovech a frázích – jsou tedy jakýmsi "plánovacím centrem" modelu

Hlubší vrstvy se více zaměřují na aktuální kontext a již vygenerovaný text

Povrchové vrstvy se specializují na bezprostřední předpověď následujícího slova

Tato specializace různých částí neuronové sítě opět připomíná specializaci různých oblastí lidského mozku, i když analogie je samozřejmě pouze přibližná.

Různé typy otázek, různé procesy myšlení

Další zajímavé zjištění se týká rozdílů v tom, jak model přistupuje k různým typům úloh:

U faktických nebo odborných otázek (např. matematických problémů) se informace o odpovědi objevují ve vnitřních reprezentacích modelu mnohem dříve

U kreativních nebo subjektivních otázek model formuluje své myšlenky postupněji, s větším "přemýšlením" v průběhu generování

Toto zjištění naznačuje, že model používá odlišné kognitivní procesy pro různé typy úloh – podobně jako lidé přistupují jinak k řešení matematického příkladu než k sepsání kreativního textu.

Praktické důsledky a proč na tom záleží?

Tento výzkum není pouze teoreticky zajímavý – má i významné praktické důsledky:

Pro vývojáře AI:

Umožňuje lépe pochopit, jak modely dospívají ke svým odpovědím.

Otevírá cestu k vývoji modelů, které mohou lépe vysvětlovat své uvažování.

Může pomoci identifikovat a opravit zdroje "halucinací" nebo nekonzistentních odpovědí.

Pro uživatele AI:

Poskytuje lepší představu o tom, jak ve skutečnosti fungují systémy, se kterými interagujeme.

Pomáhá vysvětlit, proč modely mohou být konzistentní v některých typech úloh a méně spolehlivé v jiných.

Umožňuje realističtější očekávání ohledně schopností a limitů současných jazykových modelů.

Srovnání s lidským myšlením

Je důležité zdůraznit, že navzdory podobnostem s lidským myšlením jazykové modely nemají skutečné porozumění nebo vědomí. Jejich "myšlenky" jsou ve skutečnosti matematické reprezentace v neuronových sítích, nikoli vědomé úvahy.

Přesto jsou paralely fascinující. Výzkum naznačuje, že efektivní zpracování jazyka – ať už biologickým mozkem nebo umělou neuronovou sítí – může vyžadovat určité společné principy organizace a postupného zpracování informací.

Budoucí směry výzkumu

Tento průlomový výzkum otevírá mnoho nových otázek a směrů pro další zkoumání:

Jak by šlo využít znalost těchto vnitřních procesů k vytvoření modelů, které jsou transparentnější a důvěryhodnější?

Mohly by tyto poznatky pomoci vyvinout modely, které poskytují lepší vysvětlení svých odpovědí?

Existují způsoby, jak "upravit" tyto myšlenkové procesy, aby zlepšily přesnost modelů pro specifické úlohy?

Nový pohled na AI myšlení

Výzkum společnosti Anthropic nám nabízí bezprecedentní pohled do "mysli" jazykových modelů. Zjištění, že tyto modely postupně formulují své odpovědi podobným způsobem jako lidé, je významným krokem k lepšímu pochopení těchto stále složitějších systémů.

I když jazykové modely stále nejsou skutečně "myslícími" entitami v lidském slova smyslu, jejich způsob zpracování informací je složitější a strukturovanější, než se dříve předpokládalo. Jejich "myšlenky" se skutečně vyvíjejí a formulují postupně – a toto pochopení nám může pomoci vyvinout ještě schopnější, spolehlivější a užitečnější AI systémy v budoucnosti. Podobně jako lidský autor nejprve zvažuje strukturu svého článku a postupně ji rozvíjí do konkrétních vět, i jazykový model, který vytvořil tento text, nejprve formuloval hlavní myšlenky a teprve poté je rozvedl do podrobností. Není to fascinující paralela?