Gemma 3 270M: Ultrakompaktní AI pro mobilní zařízení

Rodina modelů Gemma od Google se rychle rozrůstá. Po uvedení Gemma 3 a Gemma 3 QAT pro cloud a desktopy přišla Gemma 3n pro mobily s multimodální AI. Nyní přichází Gemma 3 270M, model s 270 miliony parametrů (170 milionů pro embedding, 100 milionů pro transformerové bloky), navržený pro specifické fine-tuning. Se slovníkem 256 tisíc tokenů je ideální pro domény jako jazyky nebo specializované oblasti. Kontextové okno činí 32 tisíc tokenů, což stačí pro většinu úkolů.

Model exceluje v energetické efektivitě: v INT4 kvantizaci spotřebuje jen 0,75 % baterie Pixel 9 Pro na 25 konverzací. Běží na zařízeních s minimálně 4 GB RAM (CPU) nebo 2 GB VRAM (GPU), s velikostí souboru kolem 550 MB, kvantizované verze až 200 MB. Na Apple M4 Max dosahuje přes 650 tokenů za sekundu s nízkou latencí.

Klíčové schopnosti a nasazení

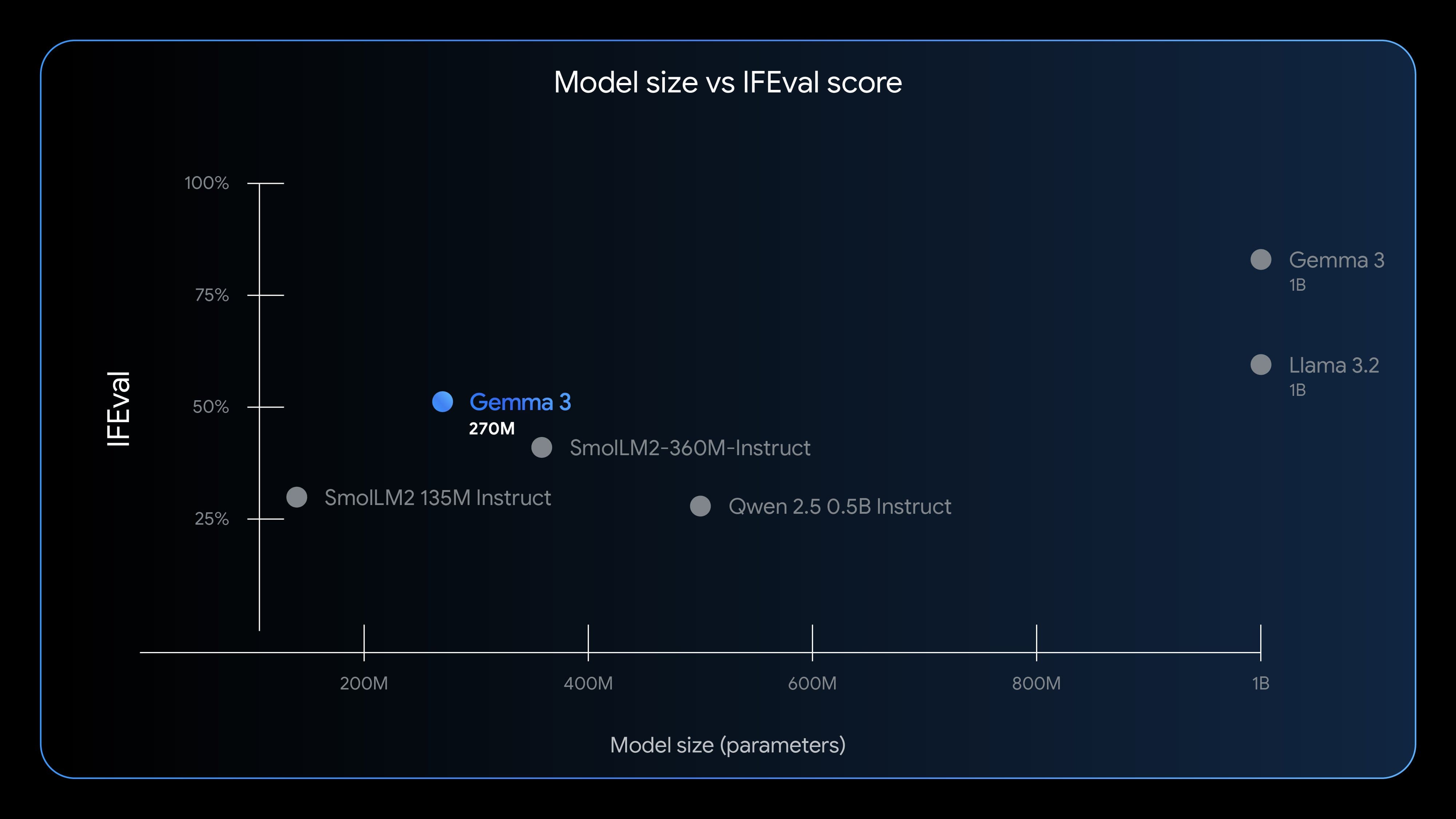

Gemma 3 270M je multimodální (zpracovává text, obrázky i video) a multijazyčný (přes 140 jazyků), s vestavěnými schopnostmi následování instrukcí podle benchmarku IFEval. K dispozici jsou předtrénované i instrukčně trénované checkpointy, včetně QAT pro INT4 přesnost bez velkého poklesu výkonu.

Fine-tuning je rychlý – lze ho provést s minimálními daty pomocí LoRA na zařízeních s 8 GB RAM a 4 GB VRAM. Podporuje platformy jako Windows, macOS, Linux a nástroje jako Hugging Face, UnSloth nebo JAX. Nasazení je možné lokálně nebo na Google Cloud Run, ideálně pro offline aplikace chránící soukromí.

Praktické využití

Model je určený pro definované úkoly jako analýza sentimentu, extrakce entit, směrování dotazů nebo kreativní psaní. Příkladem je práce Adaptive ML se SK Telecom, kde fine-tunovaná verze překonala větší modely v multijazyčném moderování. Další aplikace zahrnují Bedtime Story Generator pro offline tvorbu příběhů.

Je skvělý pro vysoký objem úkolů, kde šetří čas a náklady – běží na levné infrastruktuře nebo přímo na zařízení. Umožňuje budovat flotilu specializovaných modelů bez velkého rozpočtu.

Omezení a dostupnost

Jako kompaktní model může trpět halucinacemi a méně robustními výstupy než větší LLM. Nejsou zveřejněna trénovací data ani zdrojový kód, jen předtrénované váhy. Stáhnout lze z Hugging Face, Ollama, Kaggle, LM Studio nebo Docker. Vyzkoušejte na Vertex AI, llama.cpp, Gemma.cpp, LiteRT, Keras nebo MLX.

Gemma 3 270M, uvedená v polovině srpna 2025, posouvá hranice efektivity pro vývojáře, kteří chtějí rychlé, úsporné AI řešení na edge zařízeních. Těšíme se na vaše inovace v Gemmaverse.