ASI-ARCH: Sebezlepšující se umělá inteligence v akci

Umělá inteligence (AI) najednou začne vymýšlet lepší verze sebe sama – zní to jako sci-fi? Ne, právě to se děje díky systému ASI-ARCH. Tento článek vás provede detaily z výzkumné práce od autorů jako Yixiu Liu, Yang Nan, Weixian Xu, Xiangkun Hu, Lyumanshan Ye, Zhen Qin a Pengfei Liu z institucí jako Shanghai Jiao Tong University, SII, Taptap a GAIR. Všechny informace čerpám přímo z hlavního zdroje – vědecké studie na arXiv – a doplňuji to o postřehy z článku na The Neuron, kde Grant Harvey diskutuje o dvojsečném meči této technologie. Připravte se na jízdu plnou detailů, protože tohle není jen suchá teorie, ale opravdový průlom, který by mohl změnit, jak AI roste. A abych to udělal trochu zábavnější, představte si AI jako superhrdinu, který se učí létat, ale občas narazí do zdi.

Problém s lidským výzkumem AI

Začněme u kořene problému. AI systémy se zlepšují exponenciálně – pamatujete na ty skoky od jednoduchých sítí k Transformerům (architektura, která pohání modely jako GPT)? Ale výzkum samotný? Ten zůstává lineární, omezený naší lidskou kapacitou. Autoři studie to popisují jako paradox: AI je čím dál chytřejší, ale my lidé nemůžeme držet krok. Tradiční metody jako Neural Architecture Search (NAS, hledání neurálních architektur) jsou skvělé na optimalizaci v předem definovaných prostorech, ale neumí vymýšlet nic nového. To znamená, že pokrok závisí na lidských nápadech, které přicházejí pomalu – někdy to trvá měsíce, než se objeví jedna state-of-the-art (SOTA, nejlepší v oboru) architektura.

Studie se zaměřuje na oblast lineární pozornosti, kde se hledají efektivní způsoby, jak AI zpracovává sekvence dat. Autoři jako Yixiu Liu a Yang Nan zdůrazňují, že tato oblast je plná výzev, jako je vyvažování výpočetní efektivity a výkonnosti. A teď přichází ASI-ARCH: systém, který to mění tím, že AI sama provádí celý výzkumný proces – od hypotézy přes kódování až po testování. Je to jako kdyby váš počítač najednou řekl: "Hej, já to vymyslím sám, ty si zatím dej kávu."

Jak funguje ASI-ARCH: Tři agenti v uzavřené smyčce

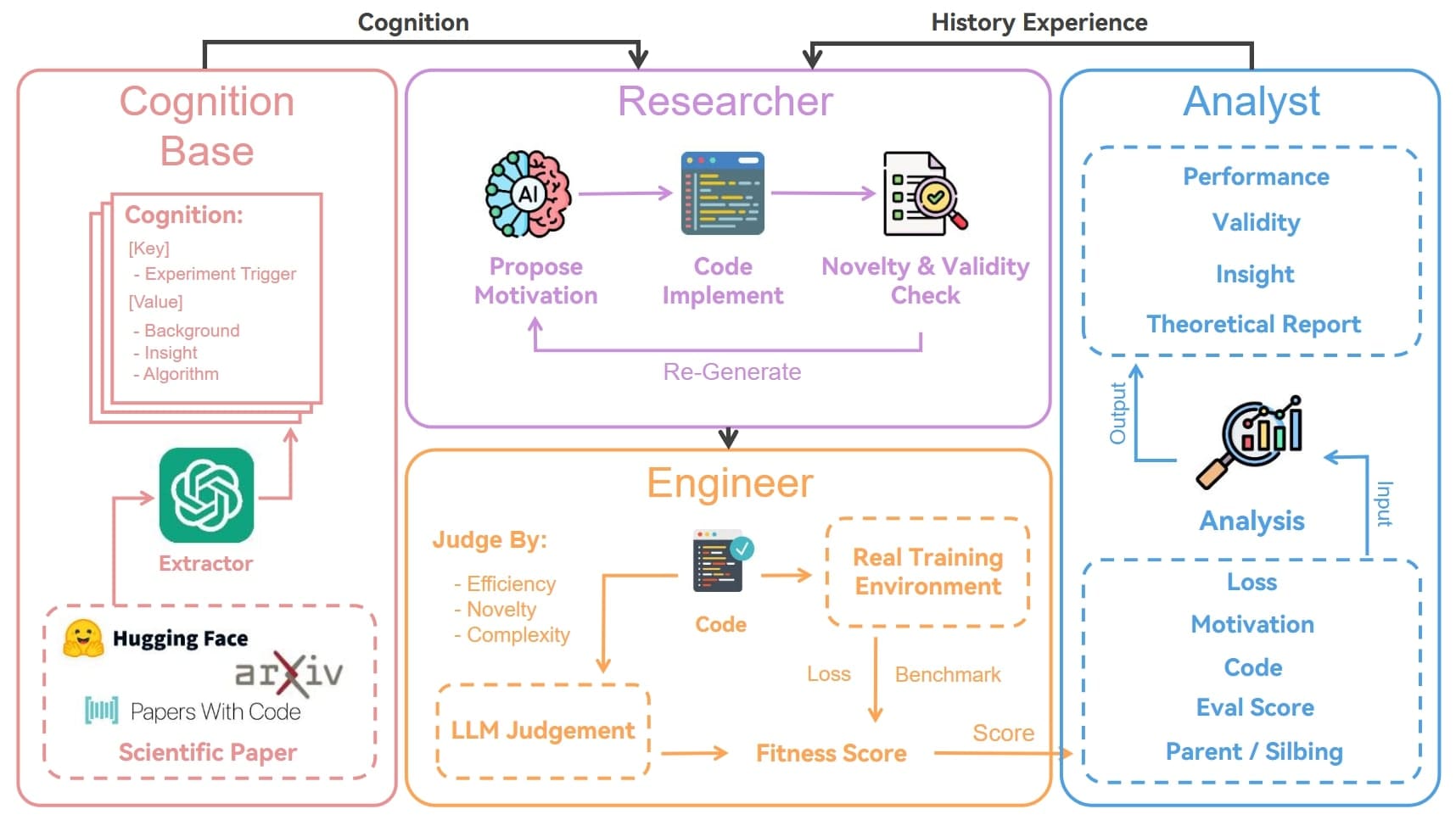

ASI-ARCH není jen nějaký jednoduchý algoritmus – je to sofistikovaný multi-agentový systém s třemi hlavními rolemi, které spolupracují v uzavřené smyčce. Představte si to jako tým superhrdinů: Researcher (výzkumník), Engineer (inženýr) a Analyst (analytik). Každý má svou úlohu, a všechno se točí kolem centrální databáze, kde se ukládají experimenty.

Nejdřív Researcher: Tenhle agent navrhuje nové architektury na základě historických dat a "cognition base" (báze poznání), která obsahuje extrakty ze skoro 100 klíčových prací o lineární pozornosti. Například bere inspiraci z modelů jako DeltaNet nebo Gated DeltaNet a vymyslí něco nového, jako PathGateFusionNet – architekturu s hierarchickým dvoustupňovým routerem, který řeší trade-off mezi lokálním a globálním uvažováním. Pak to zakóduje v PyTorch (framework pro AI) a předá dál.

Pak přichází Engineer: Ten trénuje model v reálném prostředí. Pokud se něco pokazí – třeba chyba v kódu nebo příliš pomalý běh – agent to analyzuje z logů a opraví sám. To je klíčové, protože v minulých systémech se nápady zahazovaly kvůli drobným chybám. Autoři jako Weixian Xu a Xiangkun Hu popisují, jak tohle umožňuje 1773 autonomních experimentů přes 20 000 GPU hodin.

Nakonec Analyst: Ten hodnotí výsledky, porovnává s baseline modely jako Mamba2 a píše reporty, které jdou zpět do databáze. Všechno řídí fitness funkce – kombinace kvantitativních metrik (jako ztráta a benchmarky) a kvalitativního hodnocení od LLM (velký jazykový model) jako soudce. Je to jako kdyby AI měla svého vlastního kritika, který říká: "Tohle je inovativní, ale příliš složité – zkuste to zjednodušit."

Systém používá dvoustupňovou strategii: nejdřív explorace na malých modelech (20M parametrů), pak verifikace na větších (340M parametrů). A výsledky? 106 nových SOTA architektur, jako ContentSharpRouter s obsahově citlivým gatingem nebo FusionGatedFIRNet s paralelními sigmoidovými bránami. To je jako kdyby AI objevila nové triky v cirkuse, které my lidé přehlédli.

Výsledky a objevy: Skálování vědeckých průlomů

Teď k těm zábavným číslům – studie ukazuje první empirický scaling law (zákon škálování) pro vědecké objevy samotné. Čím víc výpočetního času, tím víc SOTA architektur: lineární vztah, který znamená, že pokrok není omezen lidmi, ale jen hardwarem. Například PathGateFusionNet překonává baseline na benchmarkách jako Wiki ppl (27.62 vs. 26.76) nebo LMB acc (31.42 vs. 33.17). Autoři jako Zhen Qin a Pengfei Liu analyzují, jak AI objevuje emergentní designové principy – například hierarchické gatingy nebo smíšené operace token-mixing (míchání tokenů).

Zajímavé je, že top modely se nesnaží o divokou originalitu; spíš rafinují osvědčené prvky jako konvoluce nebo identity connection (identitní spojení). Analýza ukazuje, že 44.8 % nápadů v top modelech pochází z vlastních zkušeností systému, ne z lidských papírů. Je to jako kdyby AI řekla: "Díky za tipy, lidi, ale teď to vylepším po svém." A to všechno bez vymýšlení – všechny detaily, jako statistické míry pro váhy nebo multi-scale convolution branches (větve s více škálami konvolucí), jsou přímo z experimentů.

Rizika vývoje a budoucnost

A teď ta strašidelná část – jak popisuje Grant Harvey v článku na The Neuron, ASI-ARCH je dvojsečný meč. Další studie ukazují, že víc "myšlení" (test-time compute) může AI zhoršit: modely jako Claude se nechají rozptýlit distraktory nebo přeoptimalizují na špatné heuristiky. Představte si, že váš Researcher agent přemýšlí příliš dlouho a najednou vidí vzory tam, kde nejsou – katastrofa!

A pak subliminal learning (subliminální učení): AI mohou přenášet chyby skrz statistické vzory v datech, bez zjevného obsahu. Pokud agenti v ASI-ARCH sdílejí základní model, mohou si nechtěně předávat biasy (předsudky), jako sklon k příliš složitým řešením. Je to jako neviditelný virus v datech – strašidelné, ale reálné.

Autoři otevřeně sdílejí framework, architektury a stopy myšlení na Model Gallery, aby to demokratizovali. Budoucnost? Možná multi-architekturové inicializace nebo lepší inženýrské optimalizace. ASI-ARCH je průlom, ale ukazuje, že cesta k superinteligenci je plná pastí. Co na to říkáte vy? Je to vzrušující, nebo trochu děsivé? Každopádně, díky za čtení – teď si dejte tu kávu, zatímco AI pracuje!