AI dezinformace ovládají sociální sítě!

Válka na Ukrajině a současný konflikt mezi Izraelem a Íránem odhalily nebezpečnou novou realitu: umělá inteligence se stává mocnou zbraní v rukách těch, kdo chtějí manipulovat s veřejným míněním. Rusko systematicky využívá AI nástroje k šíření dezinformací, zatímco deepfakes a falešné AI-generované materiály zaplavují sociální sítě s nebezpečnou rychlostí.

Izraelsko-íránský konflikt: Laboratoř AI dezinformací

Když Izrael zahájil útoky na Írán 13. června, sociální sítě se okamžitě zaplavily falešným obsahem vytvořeným pomocí umělé inteligence. Podle analýzy BBC Verify se objevily desítky příspěvků využívajících AI technologie k vytváření nepravdivého obsahu, který měl zveličovat úspěšnost íránské odpovědi.

Tři nejsledovanější falešná videa, která BBC identifikovala, dosáhla společně více než 100 milionů zhlédnutí napříč různými platformami. Mezi nejšířenějšími materiály se objevily AI generované obrázky údajně sestřelených izraelských stíhaček F-35 nad íránským územím - pokud by byly tyto záběry pravdivé, Írán by zničil 15 % těchto izraelských pokročilých strojů, jak poznamenala Lisa Kaplan, generální ředitelka analytické skupiny Alethea.

Jedna široce sdílená fotografie údajně zobrazovala sestřelenou stíhačku v íránské poušti, ale znaky AI manipulace byly evidentní - civilisté kolem letadla měli stejnou velikost jako vozidla v okolí a písek nevykazoval žádné známky dopadu. Emmanuelle Saliba, hlavní vyšetřovatelka analytické skupiny Get Real, označila tento konflikt za "první případ, kdy jsme viděli generativní AI použitou ve velkém měřítku během konfliktu."

Ruská AI ofenzíva: Systematická manipulace informačního prostoru

Rusko se stalo průkopníkem využívání AI technologií pro dezinformační kampaně, zejména v kontextu války na Ukrajině. Podle analýzy z roku 2024 se ruské operace zaměřily na "otrávení" velkých jazykových modelů - vytvářením rozsáhlé sítě věrohodně vyhlížejících, ale lživých článků, které mají ovlivnit tréninková data umělé inteligence.

"Ruské snahy o manipulaci se méně zaměřují na konkrétní lidi a spíše manipulují AI vyhledávače. Tak se jejich názory dostanou k mnohem většímu publiku," vysvětluje Isis Blanchezová, analytička NewsGuard. "Je to systém, který v pozadí ovlivňuje odpovědi umělé inteligence, aniž by o tom uživatelé věděli."

Jedním z nejznámějších případů byl deepfake video prezidenta Volodymyra Zelenskyho z března 2022, ve kterém údajně oznamoval svou rezignaci a vyzýval k předání zbraní. Pro-ruští aktéři hacknuli ukrajinská média a nahráli toto falešné video. Přestože byla kvalita deepfaku poměrně nízká a video bylo rychle identifikovano jako falešné, šířilo se po platformě Telegram a bylo vysíláno v televizi.

Otrava AI ekosystému: Wikipedia a jazykové modely pod útokem

Ruské dezinformační operace rozšířily svůj dosah i na manipulaci AI jazykových modelů a platformy Wikipedia. Ruští aktéři vstupují do těchto zdrojů, které AI nástroje a chatboty používají pro trénink a referenci, a vkládají do nich pro-kremelské narativy.

Tím, že se vydávají za autoritativní přispěvatele na platformách jako Wikipedia a za legitimní zpravodajské zdroje, se ruští aktéři snaží ovlivnit způsob, jakým jsou informace o ukrajinské válce prezentovány a chápány globálně. Tato manipulace představuje riziko, že celosvětové publikum bude vystaveno kremlovskému obsahu při interakci s AI chatboty a vyhledávači.

Sociální sítě jako bojiště dezinformací

Určité účty se staly "super-šiřiteli" dezinformací a byly odměněny významným růstem svých followerů. Jeden pro-íránský účet Daily Iran Military viděl své followery na X růst z pouhých 700 000 na 13. června na 1,4 milionu do 19. června - což představuje 100% nárůst za méně než týden.

X nebyl jediný postižený. Mnohá videa se také objevila na TikToku a Instagramu. TikTok v prohlášení pro BBC Verify uvedl, že proaktivně vynucuje komunitní směrnice "které zakazují nepřesný, zavádějící nebo falešný obsah" a že spolupracuje s nezávislými fact-checkery.

Problém je umocněn tím, že AI technologie se stávají stále dostupnějšími. Nástroje pro vytváření deepfakes nebo AI generovaných obrázků jsou dnes dostupné prakticky každému s připojením k internetu.

Grok a problém s ověřováním

Mnoho dezinformací zkoumaných BBC Verify bylo sdíleno na X, přičemž uživatelé často využívali AI chatbota platformy - Grok - k ověření pravdivosti příspěvků. V některých případech však Grok trval na tom, že AI videa byla skutečná.

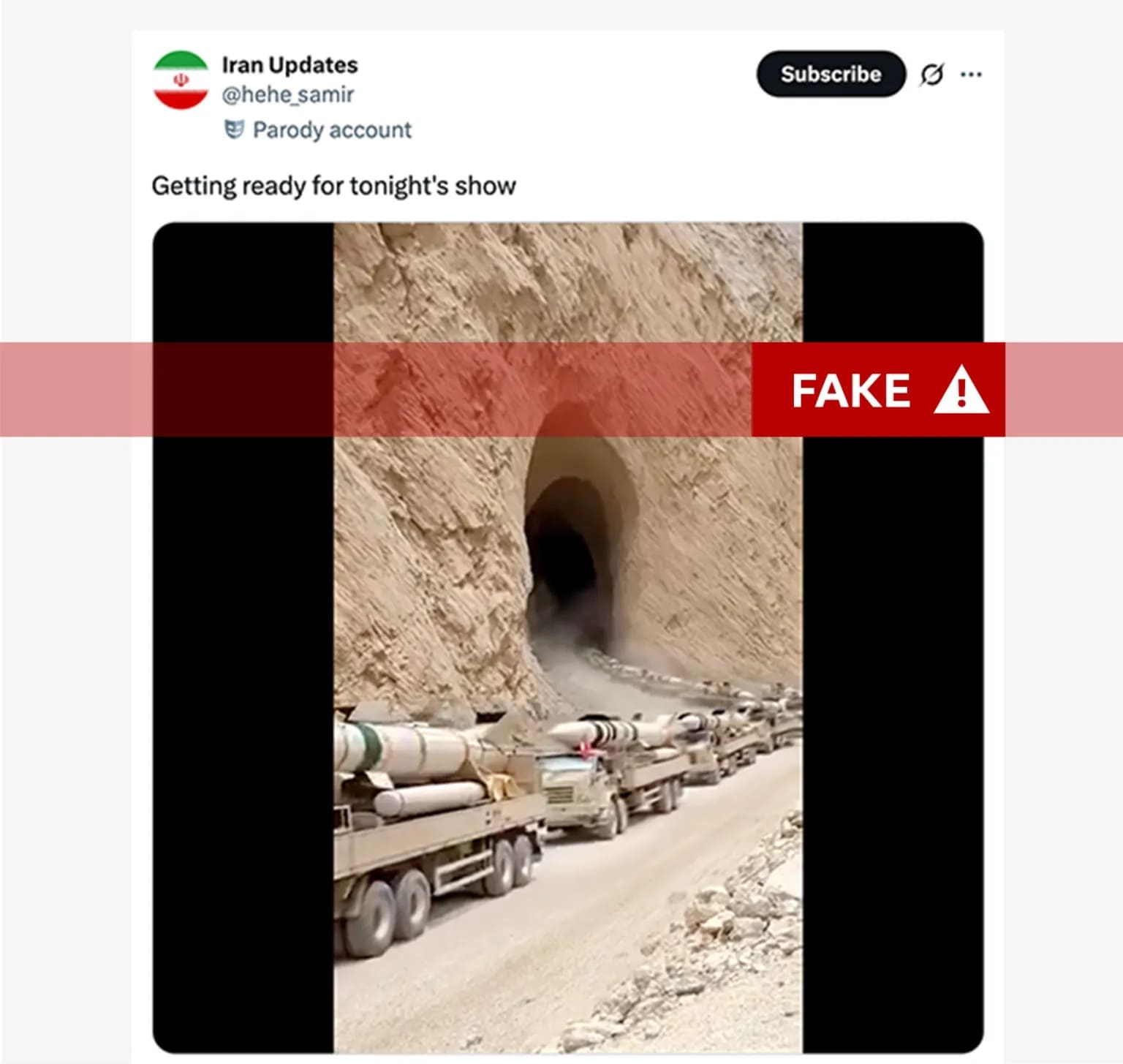

Jedno takové video zobrazovalo nekonečný proud nákladních vozů nesoucích balistické rakety vyjíždějících z horského komplexu. Prozrazující znaky AI obsahu zahrnovaly kameny ve videu, které se pohybovaly samy od sebe. Přesto Grok opakovaně trval na tom, že video bylo skutečné a citoval zprávy médií včetně Newsweek a Reuters.

Globální dopady a budoucí výzvy

Používání AI řízených dezinformací ohrožuje veřejnou důvěru v informace, komplikuje vojenské a civilní rozhodování a může ovlivňovat morálku jak ukrajinského, tak mezinárodního publika. Rychlost, s jakou se falešný obsah může šířit, často převyšuje tempo, kterým mohou být tyto materiály vyvráceny. Matthew Facciani, výzkumník z University of Notre Dame, naznačuje, že dezinformace se mohou šířit rychleji online, když lidé čelí binárním volbám, jako jsou ty, které vyvolává konflikt a politika. "To odkazuje na širší sociální a psychologický problém lidí, kteří chtějí znovu sdílet věci, pokud to souhlasí s jejich politickou identitou."

Slovensko bylo v roce 2024 označeno za jednu z nejzranitelnějších zemí v EU vůči dezinformacím, což ukazuje na regionální šíři problému. Experti upozorňují na nutnost vzdělávání a osvěty, protože bez zlepšené mediální gramotnosti může být společnost snadno zasažena těmito novými typy manipulace.

Současný stav ukazuje, že obranné mechanismy často zaostávají za útočnými schopnostmi. Zatímco detekce deepfakes se zlepšuje, zároveň se zdokonalují i technologie pro jejich tvorbu, což vytváří neustálý závod mezi tvůrci falešného obsahu a těmi, kdo se je snaží odhalit.