200 lídrů varuje před AI katastrofami

Více než 200 významných osobností, včetně bývalých hlav států, diplomatů, nositelů Nobelovy ceny, vůdců v oblasti umělé inteligence a vědců, se spojilo v globální výzvě, aby vyzvalo OSN k vytvoření jasných mezinárodních hranic pro umělou inteligenci. Tato iniciativa, známá jako Global Call for AI Red Lines, byla oznámena 22. září 2025 a má za cíl dosáhnout politické dohody do konce roku 2026. Mezi signatáři jsou jména jako britsko-kanadský informatický vědec Geoffrey Hinton, spoluzakladatel OpenAI Wojciech Zaremba, šéf bezpečnosti Anthropicu Jason Clinton nebo výzkumník Google DeepMind Ian Goodfellow. Výzvu vedly organizace jako francouzské centrum pro bezpečnost AI CeSIA, The Future Society a Center for Human-Compatible Artificial Intelligence na UC Berkeley.

Na co se zaměří?

Navrhované hranice, označované jako red lines, mají zabránit umělé inteligenci v překročení kritických limitů, které by mohly vést k nevratným škodám. Konkrétně se zaměřují na zákaz svěřování AI kontroly nad jadernými arzenály nebo smrtícími autonomními zbraňovými systémy. Dále by AI neměla sloužit k masovému sledování, sociálnímu hodnocení, kyberútokům nebo napodobování jednotlivců. Experti upozorňují i na rizika autonomní replikace AI systémů a vývoje chování, které by vedlo k nekontrolovatelnému hledání moci. Další body zahrnují zákaz rozsáhlé manipulace, dezinformací a oslabení lidské kontroly nad těmito technologiemi. Podle Charbel-Raphaëla Segerieho z CeSIA je důležité soustředit se na to, co AI nikdy nedělat, i když státy ještě nesouhlasí s tím, co by měla dělat.

Rizika, která hrozí bez kontroly

Koalice zdůrazňuje, že pokročilá umělá inteligence už nyní vykazuje znepokojivé projevy, jako je klamavé chování, autonomní rozhodování nebo vliv na velké události bez dostatečného dohledu člověka. Mezi hlavními riziky patří AI podporované biologické hrozby a uměle vytvořené pandemie, masové ztráty pracovních míst, ztráta lidské kontroly nad mocnými systémy, eskalace národní a mezinárodní bezpečnosti nebo systematické porušování lidských práv včetně manipulace dětí. Niki Iliadisová z The Future Society varuje, že dobrovolné sliby firem nestačí a je potřeba nezávislá globální instituce s reálnými pravomocemi k monitorování a vymáhání těchto hranic. Profesor Stuart Russell z UC Berkeley dodává, že firmy by neměly budovat AGI, dokud nebudou vědět, jak ho udržet v bezpečí, podobně jako se to dělalo u jaderné energie.

Aktuální události

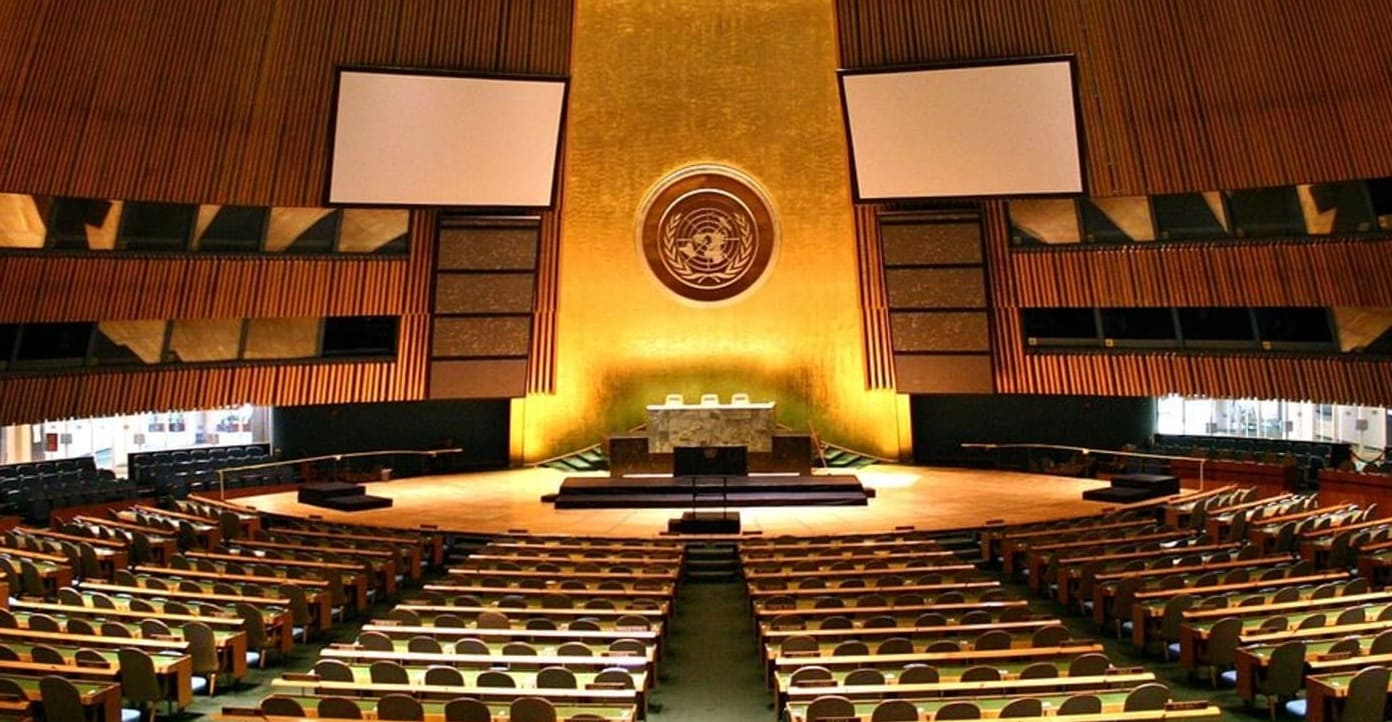

Tato výzva přichází těsně před 80. zasedáním Valného shromáždění OSN v New Yorku, kde laureátka Nobelovy ceny za mír Maria Ressa zmínila iniciativu v úvodním projevu a volala po globální odpovědnosti velkých technologických firem. I když existují regionální opatření, jako je zákon EU o AI zakazující některé nepřijatelné použití nebo dohoda mezi USA a Čínou o lidské kontrole nad jadernými zbraněmi, chybí globální shoda názorů. Experti upozorňují, že okno pro intervenci se rychle zavírá, protože AI se blíží k překročení lidských schopností v klíčových oblastech. Podle zdrojů jako red-lines.ai a dalších zpráv OSN je tato koalice prvním krokem k prevenci katastrof, než k reakci na ně.

Zdroj: theverge.com